#### 要約* GoogleはGemma 4向けのマルチトークン予測(MTP)ドラフターを発表し、推論時の速度を最大3倍向上させながら、出力品質の低下を防いだ。* この技術は「推測デコーディング」と呼ばれ、軽量な「ドラフター」モデルを使って複数のトークンを一度に予測し、メインモデルがそれを並行して検証することで、一トークンずつのボトルネックを回避する。* MTPドラフターはHugging Face、Kaggle、Ollamaで、Gemma 4と同じApache 2.0ライセンスの下で提供されており、vLLM、MLX、SGLangなどのツールと連携して動作する。自分のコンピュータでAIモデルを動かすのは素晴らしい—しかし、それができなくなる瞬間もある。プライバシー、サブスクリプション料金なし、データがマシンから出ていかないという約束。だが、多くの人にとって現実は、文章の間にカーソルが点滅するのを五秒間見つめるだけだ。そのボトルネックの正体は:推論速度。これはモデルの賢さとは関係ない。ハードウェアの問題だ。標準的なAIモデルは、一度に一つの単語断片(トークンと呼ばれる)を生成する。ハードウェアは何十億ものパラメータをメモリから計算ユニットへと移動させる必要があり、それだけで遅い。これは設計上遅いのだ。消費者向けハードウェアでは、非常に苛酷だ。多くの人が取る回避策は、小さくて弱いモデルを動かすか、圧縮されたクォンタイズモデルを使うことだ。これらは速度のために品質を犠牲にしている。どちらも完璧ではない。動作はするが、望んだモデルではない。そこでGoogleは別のアイデアを打ち出した。同社はGemma 4シリーズのオープンモデル向けにマルチトークン予測(MTP)ドラフターをリリースした。これは、モデルの品質や推論能力を犠牲にせずに最大3倍の高速化を実現できる技術だ。このアプローチは「推測デコーディング」と呼ばれ、長年にわたり概念として存在してきた。Googleの研究者は2022年に基礎論文を発表した。この技術が主流にならなかったのは、スケールで動かすための適切なアーキテクチャが必要だったからだ。仕組みの短い説明はこうだ。大きくて強力なモデルにすべてを任せるのではなく、小さな「ドラフター」モデルと組み合わせる。ドラフターは高速で安価—一度に複数のトークンを予測し、メインモデルがそれを一度に検証する。正解なら、そのシーケンス全体を一回の前方伝播で得られる。 Googleによると、「ターゲットモデルがドラフトに同意すれば、全シーケンスを一度の前方伝播で受け入れ、さらに自分のトークンを一つ生成することもできる」とのことだ。 何も犠牲にしない:Gemma 4の31B密なバージョンのような大きなモデルでも、すべてのトークンを検証し続け、出力品質は変わらない。遅い部分で使われていなかったアイドル状態の計算能力を活用しているだけだ。 Googleは、ドラフターのモデルがターゲットモデルのKVキャッシュ—すでに処理済みのコンテキストを保存するメモリ構造—を共有していると述べている。これにより、大きなモデルがすでに知っていることを再計算する無駄を省いている。 スマートフォンやRaspberry Pi向けに設計された小型エッジモデルには、生成時間をさらに短縮するための効率的なクラスタリング技術も導入した。これはAI界がテキスト生成の並列化を試みた唯一の例ではない。Inception LabsのMercuryのような拡散型言語モデルは全く異なるアプローチを採用している。ノイズから始めて反復的に出力を洗練させる方法だ。理論上は高速だが、拡散型LLMは従来のトランスフォーマーモデルの品質に追いつくのに苦労しており、研究段階の好奇心の対象にとどまっている。推測デコーディングは根本的にモデルを変更しない点が異なる。これはサービスの最適化であり、アーキテクチャの置き換えではない。既に使っているGemma 4はより高速になるだけだ。実用的なメリットは確かだ。Googleのベンチマークによると、Nvidia RTX Pro 6000デスクトップGPU上で動作するGemma 4 26Bモデルは、MTPドラフターを有効にすると約2倍のトークンを秒間生成できる。Apple Siliconでは、バッチサイズ4〜8のリクエストで約2.2倍の高速化が可能だ。3倍の上限には届かないが、「ほとんど使えない」から「実際に使える」レベルへの大きな差だ。ここで重要なのはコンテキストだ。2025年1月に中国のモデルDeepSeekが市場を驚かせ、Nvidiaの時価総額から6,000億ドルを一日で消し去ったとき、核心的な教訓は「効率化の向上は生の計算能力以上のインパクトを持つ」ということだった。より賢く動かすことが、ハードウェアを増やすよりも効果的だ。GoogleのMTPドラフターもその方向性の一つで、消費者向け市場を狙ったものだ。AI業界は今、推論、トレーニング、メモリの三角形のような構造だ。いずれかの分野での突破口は、エコシステム全体に波及や衝撃をもたらす。DeepSeekの低コストハードウェアで強力なモデルを実現したトレーニング手法や、Googleのメモリ削減技術(品質を落とさずにAIのメモリを縮小した論文)も例だ。両者とも市場を揺るがし、企業は何をすべきか模索した。Googleは、「応答性の向上:ほぼリアルタイムのチャット、没入型音声アプリケーション、エージェントワークフローのレイテンシを大幅に削減」と述べている。これらのタスクは低レイテンシが求められるため、実用的だ。ユースケースはすぐに明確になる:遅延のないローカルコーディングアシスタント、質問を忘れる前に応答する音声インターフェース、ステップ間の待ち時間を3秒に抑えるエージェントワークフロー。すべて既存のハードウェア上で実現可能だ。MTPドラフターは、Hugging Face、Kaggle、Ollamaで今すぐ利用可能で、Apache 2.0ライセンスの下で提供されている。vLLM、MLX、SGLang、Hugging Face Transformersとすぐに連携できる。

GoogleがローカルAIを最大3倍高速化する方法を発見—新しいハードウェアは不要

要約

自分のコンピュータでAIモデルを動かすのは素晴らしい—しかし、それができなくなる瞬間もある。 プライバシー、サブスクリプション料金なし、データがマシンから出ていかないという約束。だが、多くの人にとって現実は、文章の間にカーソルが点滅するのを五秒間見つめるだけだ。 そのボトルネックの正体は:推論速度。これはモデルの賢さとは関係ない。ハードウェアの問題だ。標準的なAIモデルは、一度に一つの単語断片(トークンと呼ばれる)を生成する。ハードウェアは何十億ものパラメータをメモリから計算ユニットへと移動させる必要があり、それだけで遅い。これは設計上遅いのだ。消費者向けハードウェアでは、非常に苛酷だ。

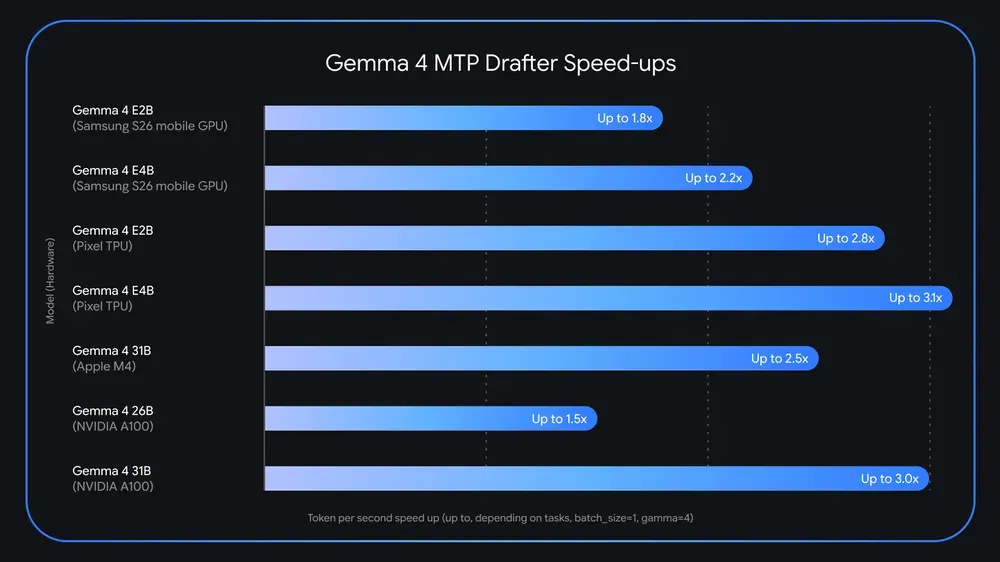

多くの人が取る回避策は、小さくて弱いモデルを動かすか、圧縮されたクォンタイズモデルを使うことだ。これらは速度のために品質を犠牲にしている。どちらも完璧ではない。動作はするが、望んだモデルではない。 そこでGoogleは別のアイデアを打ち出した。同社はGemma 4シリーズのオープンモデル向けにマルチトークン予測(MTP)ドラフターをリリースした。これは、モデルの品質や推論能力を犠牲にせずに最大3倍の高速化を実現できる技術だ。

このアプローチは「推測デコーディング」と呼ばれ、長年にわたり概念として存在してきた。Googleの研究者は2022年に基礎論文を発表した。この技術が主流にならなかったのは、スケールで動かすための適切なアーキテクチャが必要だったからだ。

仕組みの短い説明はこうだ。大きくて強力なモデルにすべてを任せるのではなく、小さな「ドラフター」モデルと組み合わせる。ドラフターは高速で安価—一度に複数のトークンを予測し、メインモデルがそれを一度に検証する。正解なら、そのシーケンス全体を一回の前方伝播で得られる。

Googleによると、「ターゲットモデルがドラフトに同意すれば、全シーケンスを一度の前方伝播で受け入れ、さらに自分のトークンを一つ生成することもできる」とのことだ。

何も犠牲にしない:Gemma 4の31B密なバージョンのような大きなモデルでも、すべてのトークンを検証し続け、出力品質は変わらない。遅い部分で使われていなかったアイドル状態の計算能力を活用しているだけだ。

Googleは、ドラフターのモデルがターゲットモデルのKVキャッシュ—すでに処理済みのコンテキストを保存するメモリ構造—を共有していると述べている。これにより、大きなモデルがすでに知っていることを再計算する無駄を省いている。

スマートフォンやRaspberry Pi向けに設計された小型エッジモデルには、生成時間をさらに短縮するための効率的なクラスタリング技術も導入した。

これはAI界がテキスト生成の並列化を試みた唯一の例ではない。Inception LabsのMercuryのような拡散型言語モデルは全く異なるアプローチを採用している。ノイズから始めて反復的に出力を洗練させる方法だ。理論上は高速だが、拡散型LLMは従来のトランスフォーマーモデルの品質に追いつくのに苦労しており、研究段階の好奇心の対象にとどまっている。

推測デコーディングは根本的にモデルを変更しない点が異なる。これはサービスの最適化であり、アーキテクチャの置き換えではない。既に使っているGemma 4はより高速になるだけだ。

実用的なメリットは確かだ。Googleのベンチマークによると、Nvidia RTX Pro 6000デスクトップGPU上で動作するGemma 4 26Bモデルは、MTPドラフターを有効にすると約2倍のトークンを秒間生成できる。Apple Siliconでは、バッチサイズ4〜8のリクエストで約2.2倍の高速化が可能だ。3倍の上限には届かないが、「ほとんど使えない」から「実際に使える」レベルへの大きな差だ。

ここで重要なのはコンテキストだ。2025年1月に中国のモデルDeepSeekが市場を驚かせ、Nvidiaの時価総額から6,000億ドルを一日で消し去ったとき、核心的な教訓は「効率化の向上は生の計算能力以上のインパクトを持つ」ということだった。より賢く動かすことが、ハードウェアを増やすよりも効果的だ。GoogleのMTPドラフターもその方向性の一つで、消費者向け市場を狙ったものだ。

AI業界は今、推論、トレーニング、メモリの三角形のような構造だ。いずれかの分野での突破口は、エコシステム全体に波及や衝撃をもたらす。DeepSeekの低コストハードウェアで強力なモデルを実現したトレーニング手法や、Googleのメモリ削減技術(品質を落とさずにAIのメモリを縮小した論文)も例だ。両者とも市場を揺るがし、企業は何をすべきか模索した。

Googleは、「応答性の向上:ほぼリアルタイムのチャット、没入型音声アプリケーション、エージェントワークフローのレイテンシを大幅に削減」と述べている。これらのタスクは低レイテンシが求められるため、実用的だ。

ユースケースはすぐに明確になる:遅延のないローカルコーディングアシスタント、質問を忘れる前に応答する音声インターフェース、ステップ間の待ち時間を3秒に抑えるエージェントワークフロー。すべて既存のハードウェア上で実現可能だ。

MTPドラフターは、Hugging Face、Kaggle、Ollamaで今すぐ利用可能で、Apache 2.0ライセンスの下で提供されている。vLLM、MLX、SGLang、Hugging Face Transformersとすぐに連携できる。