元のソース: NextQuestion 画像ソース: Unbounded AIによって生成大規模言語モデル(LLM)と対話すると、私たちは常に、それらが実際に意識しているのではないかという漠然とした感覚を持っています。 しかし、神経科学者の視点から見ると、この見解は持ちにくいようです。Cell誌のサブジャーナル「Trends in Neurosciences」に掲載された最近の論文では、コンピューターサイエンス、生物学、神経科学の3人の研究者が、「人工知能は意識を生成できるのか」という疑問を掘り下げました。結論として、彼らはLLMが現在の形では意識的になることができないことに同意します。 このような断定的な見方はどのようにして生まれたのでしょうか。 **▷**出典: Cell## **LLMと意識**どの動物が意識を持っているのか、動物以外のどの存在が意識を持っているのかは長い間疑問視されてきました。 最近のLLMの出現は、この問題にまったく新しい視点をもたらしました。 それは、私たちの会話能力(人間の意識の現れ)を示し、「理解」「知性」「意識」の3つの概念を再定義し、再考させます。LLMは、人間同士の自然言語会話を含む数百億語のテキストデータでトレーニングされた数十億の接続重みを持つ、複雑で多層的な人工ニューラルネットワークです。 テキストで質問をすることで、ユーザーは魅力的なシミュレートされたコンテキストに引き込まれます。 時間をかけてこれらのシステムを使用する意思があれば、ネットワークの深さと品質に圧倒されずにはいられません。 それに質問をすると、その反応はしばしば、意識的な個人が生み出すことができるものと微妙に似ています。 したがって、洞察力に富み、意識的な個人として、私が受け取る答えは、同じく「意識的」であり、考え、感じ、推論し、経験することができる個人によって生成されたと結論付けるのは簡単です。 **このような「チューリングテスト」の結果から、LLMはすでに意識を持っているのか、それともすぐに意識を持つようになるのか、疑問に思わずにはいられません。 しかし、この問いは、逆に「意識」覚醒の瀬戸際を繰り返すLLMを開発し続けることが倫理的かどうか、といった倫理的ジレンマの連続につながることになる。 LLMが「意識的」であるという考えは、今日の神経科学コミュニティでは普遍的に受け入れられているわけではありませんが、AIシステムの能力が向上し続けるにつれて、この考えの議論が必然的に前面に出てきています。 また、大手メディアでも広く議論されており、神経科学者は自らの専門的な視点から客観的に解釈するようになりました。 LLMが潜在的に意識的であるという考えは、LLMのアーキテクチャは脳の特性に大きく触発されており(図1)、脳は現時点で自信を持って「意識的」に帰することができる唯一の対象であるという重要な議論によってしばしば支持されています。 初期の人工ニューラルネットワークは、大脳皮質の簡略化されたバージョンに基づいて設計されましたが、現代のLLMは高度に設計され、特定の目的に適応しており、既知の脳構造との深い相同性を保持していません。 実際、LLMを計算能力の高いものにする経路の特徴の多く(図1)は、哺乳類の意識の生成と形成に因果関係を持つと現在考えられているシステムとは大きく異なるアーキテクチャを持っています。 例えば、意識生成に関する多くの神経科学理論は、視床皮質系と覚醒系が意識の処理において中心的な役割を果たしていることを示唆しているが、これらは現代のLLMでは利用できない。 図1:哺乳類の脳と大規模言語モデルの巨視的なトポロジカルな違い 出典:Trends in Neurosciencesこの時点で、LLMのアーキテクチャが脳の特性を模倣することがそれほど重要なのか、と疑問に思う人もいるかもしれません。私たちの意見では、主な理由は、複雑な身体に埋め込まれた脳から来る、現時点では1つの意識の存在しか確信できないことです。 厳密に言えば、この議論はさらに人間だけに絞り込まれるかもしれないが、主観的意識に重要な役割を果たすと考えられているシステムレベルの形質の多くは、哺乳類、さらには無脊椎動物にまで及ぶ生物学的スペクトル全体に広がっている。そうは言っても、まず「意識」の正確な意味から始めましょう。 次に、現在のAIシステムが意識を持っている、または将来すぐに意識を持つという考えに反対する3つの議論を提示します。* **1. 意識は、生物にとって意味のある感覚の流れと関連しています。* **2. 哺乳類の脳では、意識は高度に相互接続された視床皮質系によって支えられています。* **3. 意識は、生物システムの複雑な生物学的組織と不可分なものかもしれません。 **## **意識って何?意識は複雑な概念であり、その定義は議論されてきました。 人間のコミュニケーション能力と相互作用能力の文脈では、コミュニケーションと対話の能力は、人が意識を持っているかどうかを評価するための本能的な要素です。LLMとの言語ベースのインタラクティブな会話は、多くの場合、LLMが意識的である可能性が高いかどうかを判断するための出発点となる直感的な感覚を発達させます。 しかし、LLMはインタラクティブな会話に優れていますが、これは意識の正式な客観的尺度を満たしておらず、知能の予備的な証拠にすぎません。 **LLMの出現により、人は他者との言語的相互作用から直接意識を生み出すことができるかどうかを再評価するようになりました。 したがって、人間らしい能力や人間らしい特性を判断する基準を改める必要があるという見方が新たになってきました。「意識」という言葉には、しばしば異なる意味があります。 たとえば、神経科医はしばしば「意識レベル」に言及しますが、これは人が意識を持っているかどうかの最初の評価であり、次に意識のレベルまたは特定の状態をより詳細な方法で評価します。 一方、心理学者は、意識の内容、つまり個人の内なる世界の特定の経験、記憶、思考に関心があります。 また、意識の内容によって違いがあります。 私たちの経験は、現象的または経験的(例えば、リンゴを見たり匂いを嗅いだり、腕に触れたり)として説明することも、より抽象的な形(例えば、概念的記憶をどのように想像し、想像し、操作するか)で説明することができます。AIシステムが意識を持っているかどうかという質問には、意識のいくつかの意味に焦点を当てることも、意識のすべての意味に同時に焦点を当てることもできます。 以下では、主に現象的認識に着目し、機械が世界を現象的に体験できるのかを探ります。## **環境について**外界を知覚する過程で使用できる生物の部分は、その環境と呼ばれます。 たとえば、人間の網膜は380nm〜740nmの波長の光に反応します、つまり、網膜は青から赤までのスペクトルを知覚することができます。 外部技術の助けがなければ、人間はこの波長範囲外の赤外光(>740nm)や紫外線(<380nm)を検出することはできません。 また、聴覚、体性感覚、前庭感覚、すなわち、対応する聴覚領域(人間の耳は20Hz〜20,000Hzの音を聞くことができる)、体性感覚領域(人間は体の特定の部分から約1mm以内の刺激を識別できる)、および前庭領域(人間の三半規管の相互接続された3次元構造が内部の平衡感覚を提供する)という点でも同様の環境があります。 同時に、自然界の他の種は、電磁スペクトルの他の帯域の信号を検出することができます。 たとえば、ミツバチは紫外線範囲の光を見ることができ、ヘビは従来の視覚信号に加えて赤外線放射信号を検出できます。つまり、動物が異なれば、体や脳が周囲を知覚できる感度も異なります。 アメリカの心理学者であるギブソンは、生物が特定の環境で行動する可能性を「アフォーダンス」と呼んでいます(インターネット技術の浸透に伴い、アフォーダンスは、メディアの実践や人間の日常の相互作用におけるデジタル技術の使用を説明するために使用され始めました)。 **そのアルゴリズム設計の性質上、LLMはバイナリ符号化パターンのみを持ち、バイナリ情報入力のみを受信し、今日のLLMの作業アーキテクチャを構成する複雑なトランスフォーマー構造に固有のネットワークアルゴリズムをさらに実行することができます。 ニューロンスパイクは、入力アナログ信号をデジタル信号(バイナリ信号)に符号化することもできますが、LLMに伝達される情報の流れは非常に抽象的であり、外界自体との強いつながりはありません。 文字の羅列としてエンコードされたテキストや音声は、自然界の動的な複雑さに匹敵することはできず、つまり、LLMの環境(LLMに提供されるバイナリ情報)は、目を開けたり、会話を伝達したりしたときに脳に入る情報や、それに伴う経験とは根本的に異なります。 伝統的な哲学的言説は、異なる種間の情報の流れの独自性(例えば、人間とコウモリの違い)と、これらの経験の現象学的特徴を強調している。 LLMによって得られる情報入力は、当面の間、この違いを定量化する決定的な方法はありませんが、より有意な違いを示す可能性があると考えています。そうは言っても、AIシステムのインプットは今後容赦なく豊かになっていくでしょう。 未来のLLMは、意識のあるエージェントが日常的にアクセスできる信号の種類(つまり、自然界からの統計)によりよく一致する、さまざまなタイプの入力を装備することができます。 では、将来のAIシステムの利用環境は、人間の環境よりも広いものになるのでしょうか。この問いに答えるには、人間の潜在意識や意識的な経験は、感覚的なインプットだけでは決まらないことを認識しなければなりません。 例えば、私たちがポンツーンに横たわっているとき、通常の感覚体験がなくても、まだ意識があると想像してみてください。 ここでの概念は、環境が固有の主観的な視点、つまり主体から開始することを前提としていることが強調されています。 同様に、親近感は、被験者の内的性質、特に被験者の動機と目標に依存します。 つまり、意識は環境(LLMの入力データ)だけでは生成できないということです。 そのため、単に大量のデータをAIシステムに投入するだけでは、AIシステム自体を意識することはできません。 **この視点は、意識の科学における基本的な仮定のいくつかを再考するよう促すかもしれません。 具体的には、AIシステムが次第に高度化していく中で、研究者は、ある種の意識理論が提唱する、より根源的な自己やエージェントに関連するプロセスが、意識の出現に必要であるかどうかを再評価する必要があります。## **意識の「統合」**現在、意識の神経相関については多くの研究が行われていますが、その中でも意識処理の神経回路についてはさまざまな理論があります。 意識は、高密度で高度に接続された視床皮質ネットワークによって支えられていることを強調する人もいます。 **視床-皮質ネットワークには、皮質領域、皮質-皮質接合部、および高次視床核の皮質領域への分岐投射が含まれます。 視床皮質系のこの特定の構造は、意識と意識の統合を支える循環的で複雑な思考処理を支えています(つまり、意識は異なる脳領域から生じるという事実にもかかわらず、意識は統合されています)。 しかし、意識の統合を達成する方法について、理論が異なれば見解も異なります。グローバルニューロンワークスペース理論(GNW)によると、意識は分散した前頭頂部皮質システムで構成される中央ワークスペースに依存しています。 このワークスペースは、局所皮質プロセッサからの情報を統合し、それを世界規模ですべての皮質局所プロセッサに送信し、意識的プロセスと無意識的プロセスを分離してグローバルに配信します。 他の意識理論では、意識的な統合は他の神経プロセスによって達成されると考えられています。 例えば、ニューロン樹状突起統合理論(DIT)は、意識的な統合は、異なる皮質領域間の高周波同期現象によって起こることを示唆しており、それは、関与する皮質領域に応じて、知覚、認知、運動計画などの異なる機能を含む可能性がある。  図2:ニューロン樹状突起統合(DIT)理論に基づく意識統合の神経構造 出典:Trends in Neurosciences*キャプション:DIT理論(図2)では、研究者たちは、全体的な意識的統合は、視床-皮質回路と皮質回路の両方の中心にある大きな興奮性ニューロンである皮質の第5層の錐体ニューロンの局所統合にも依存すると考えています。 このタイプのニューロンには、まったく異なる種類の情報を処理する2つの主要な構造(図2、オレンジ色と赤色の円柱)があり、基底構造(赤)は外部の基本情報を処理し、頂端構造(オレンジ色)は内部で生成された情報を処理します。 DIT理論によると、意識状態では、これら2つの構造が互いに結合し、情報が視床-皮質および皮質-皮質回路を流れることを可能にし、情報と意識生成のシステム全体の統合を可能にします。 * 現在のLLMやその他のAIシステムのアーキテクチャには、これらの理論が強調する特徴が欠けていることに注意することが重要です:既存のLLMは、同等の二構造錐体ニューロンも、中央集権的な視床アーキテクチャも、グローバルワークスペースも、上行覚醒システムの複数の特徴も持っていません。 言い換えれば、既存のAIシステムには、現在、神経科学界で意識生成の基盤として信じられている脳の特徴が欠けているのです。 哺乳類の脳は意識の生成をサポートできる唯一の構造ではないが、神経生物学の証拠は、哺乳類の意識の形成は非常に特殊な構造原理(すなわち、統合されたニューロンと興奮したニューロンの間の単純な接続)によって決定されることを示唆している。 トポロジー的には、既存のAIシステムの構造は極めて単純であり、それが既存のAIシステムを現象認識とは見なさない理由の1つです。 では、未来のAIモデルは、多くの意識理論が核としている「統合」のプロセスを、ついに統合できるようになるのでしょうか。 この問題に対して、GNW理論が提唱する「統合」という概念は、比較的簡便に実装できる方法である。 実際、最近のAIシステムの中には、ローカルプロセッサが共有するグローバルワークスペースのようなものに組み込まれているものもあります。 グローバル送信の計算処理はAIシステムに実装できるため、この理論によれば、この計算方法を採用したAIシステムには、潜在的な意識の中核的なコンポーネントが含まれていることになります。しかし、前述したように、すべての意識理論が、この統合の様式が意識の生成の鍵であることに同意しているわけではありません。 例えば、意識の統合情報理論は、現代のコンピュータは情報を完全に統合するために必要な因果推論能力を達成するための適切なアーキテクチャを備えていないため、典型的な現代のコンピュータに実装されたソフトウェアベースのAIシステムは意識を持つことができないと主張しています。 そこで、第3の可能性として、意識は原理的には達成可能であるが、AIシステムの現在(そしておそらく将来)の計算特異性のレベルを超える必要があるかもしれないという可能性について考えます。 **## **意識は複雑な生物学的プロセスである**意識の生成は、システムのアーキテクチャだけに依存しているわけではありません。 例えば、深い睡眠や麻酔をしているとき、視床皮質系の構造は変化しませんが、意識は消えます。 深い睡眠時でも、主要な感覚野における局所的な神経反応とガンマベルト活動は、意識状態のものと類似しています。 これは、意識が特定の神経プロセスに依存していることを示唆していますが、これらの神経プロセスは意識脳と無意識脳で異なります。 **意識的処理と無意識的処理の詳細な違いを明らかにするために、まずニューロン樹状突起統合(DIT)の理論に戻りましょう。 DIT理論には、意識的および無意識的に処理される神経プロセスに関連する多くの神経生物学的ニュアンスが含まれています。 DIT理論は、意識的処理と無意識的処理の主な違いは、錐体細胞の2つの区画構造の統合にあると提唱しています(図2)。 前述したように、意識的な処理の間、これら2つの構造は互いに相互作用し、視床皮質系全体が複雑な情報を処理および統合することを可能にします。 しかし、麻酔状態では、様々な麻酔薬が椎体ニューロンの2つの構造間の機能的デカップリングをもたらす。 言い換えれば、これらの脊椎ニューロンは解剖学的には無傷であり、活動電位を励起することができますが、樹状突起統合能力は生理学的に著しく制限されており、トップダウンフィードバックは処理に影響を与えることができません。 研究によると、この樹状突起結合は代謝型受容体によって制御されていますが、この構造は計算モデルや人工ニューラルネットワークでは見落とされがちです。 さらに、研究は、この場合、より高い視床核がこの代謝性受容体の活性を制御することを示している。 したがって、特定の神経生物学的プロセスが、脳内の意識の「オン」と「オフ」に関与している可能性があります。 このことは、哺乳類の脳における経験の質が、意識を生み出す根本的なプロセスと複雑な関係にあることを示唆している。 **これらの理論は十分に説得力がありますが、意識の完全な理解から生じる神経プロセスの複雑さと比較すると、この知識が見劣りすることはほぼ確実です。 現在の意識の説明は、グローバルワークスペース、統合情報、循環処理、樹状突起統合などの理論に依存していますが、真の意識が生じる生物学的プロセスは、これらの理論で現在理解されているよりもはるかに複雑である可能性があります。 現在、意識研究の議論を構成するために使われている抽象的な計算レベルの考え方は、意識を説明するために必要な計算の詳細を完全に考慮していない可能性さえあります。言い換えれば、生物学は複雑であり、バイオコンピューティングの現在の理解は限られているため(図3)、意識を理解するための適切な数学的および実験的ツールが不足している可能性があります。 ** 図2:ニューロン樹状突起統合(DIT)理論に基づく意識統合の神経構造 出典:Trends in Neurosciences*キャプション:DIT理論(図2)では、研究者たちは、全体的な意識的統合は、視床-皮質回路と皮質回路の両方の中心にある大きな興奮性ニューロンである皮質の第5層の錐体ニューロンの局所統合にも依存すると考えています。 このタイプのニューロンには、まったく異なる種類の情報を処理する2つの主要な構造(図2、オレンジ色と赤色の円柱)があり、基底構造(赤)は外部の基本情報を処理し、頂端構造(オレンジ色)は内部で生成された情報を処理します。 DIT理論によると、意識状態では、これら2つの構造が互いに結合し、情報が視床-皮質および皮質-皮質回路を流れることを可能にし、情報と意識生成のシステム全体の統合を可能にします。 * 生物学的複雑さをよりよく理解するためには、細胞レベルおよび全身レベルでの上記の生物学的プロセスは生体内で発生しなければならず、不可分であることを強調することが重要です。 生物は、現在の機械やAIアルゴリズムとは異なり、常に異なる処理レベルで自分自身を維持することができます。 また、生命システムは多面的な進化・発展の歴史を持ち、その存在は複数の組織レベルでの活動に依存しています。 意識は生命システムの組織化と複雑に結びついています。 しかし、今日のコンピュータは、この生きたシステムの組織的な複雑さ(つまり、システムの異なるレベル間の相互作用)を具現化することができていないことは注目に値します。 これは、最新のAIアルゴリズムには組織レベルの制約がなく、生きたシステムほど効果的に機能しないことを示唆しています。 つまり、AIがソフトウェアベースである限り、意識的でインテリジェントな存在には適さない可能性があるということです。 **生物学的複雑性の概念は、細胞レベルでも表現できます。 生物学的ニューロンは、数行のコードで完全にキャプチャできる単なる抽象的なエンティティではありません。 対照的に、生物学的ニューロンは多層的な組織を持ち、ニューロン内の複雑な生物物理学的プロセスのさらなるカスケードに依存しています。 例えば、細胞呼吸の基本であり、細胞の恒常性を維持するための重要なプロセスである「クレブス回路」を例にとります。 細胞呼吸は、細胞が有機分子に蓄えられたエネルギーを細胞が利用できるエネルギーの形に変換することを可能にする重要な生物学的プロセスです。 しかし、細胞呼吸などの生物物理学的プロセスは実際の物理分子に基づいている必要があるため、このプロセスをソフトウェアに「圧縮」することはできません。 もちろん、これは意識に「クレブス・サイクル」が必要だという意味ではなく、意識を理解するプロセスにも同様の課題が絡んでいるかもしれないこと、つまり、意識は根底にあるメカニズムから切り離すことができないということを強調している。 **しかし、意識は知能システムによって全く生成できないという主張に完全には賛同できませんが、意識と生命の背後にある複雑な生物学的組織との相関関係を考慮する必要があり、意識の本質を捉える計算の種類は、現在の理論が理解しているよりもはるかに複雑である可能性があります(図3)。 意識の「生検」を行い、それを組織から取り除くことはほとんど不可能です。 この見解は、意識は抽象的な計算レベルで生じうるという、意識に関する現在の多くの理論と矛盾する。 意識を完全に理解するためには、生命システムに見られるクロススケールの相互依存性と組織の複雑さを無視することはできません。 **AIシステムは、ネットワークコンピューティングのレベルで生物学的なシステムを模倣しているが、これらのシステムでは、脳内の意識と密接な因果関係を持つプロセスから、他のすべてのレベルの生物学的プロセスが抽象化されているため、既存のAIシステムは意識そのものを抽象化している可能性がある。 その結果、LLMと未来のAIシステムは、シミュレートされた意識の特徴の無限の流れに閉じ込められる可能性がありますが、現象的な意識は存在しません。 もし意識が本当にこれらの他のレベルの処理、あるいは異なるスケール間の相互作用に関係しているのなら、機械が意識を生成する可能性からはほど遠いことになります。## **まとめ**本稿では、LLMにおける意識の可能性や、未来のAIシステムを神経科学的な視点から探ります。 LLMは魅力的ですが、意識的ではなく、将来の短期間は意識的ではありません。まず、哺乳類の環境(哺乳類が知覚できる外界の「ごく一部」)とLLMの非常に貧しく限られた環境との大きな違いを説明します。 第二に、LLMのトポロジーは非常に複雑であるが、経験的には哺乳類の意識関連回路の神経生物学的詳細とは大きく異なっており、したがってLLMが現象的な意識を生成できると考える正当な理由はないと主張する(図1)。 生命システムに内在するが、AIシステムには明らかに存在しない生物学的組織の複雑さから意識を抽象化することは、まだ不可能です。 全体として、上記の3つの重要なポイントにより、LLMは現在の形では意識的になることは不可能です。 それらは、意識的な経験の豊かさを説明するために使用される人間の自然言語コミュニケーションの特徴を模倣しているだけです。この記事を通じて、提示された議論が単なる異議を表すのではなく、何らかの肯定的な影響と反省をもたらすことを願っています(未解決の質問を参照)。 第一に、LLMの認識された能力に関する現在の潜在的な倫理的懸念は、現実よりも仮説です。 さらに、LLMと哺乳類の脳トポロジーの類似点と相違点をより深く理解することで、機械学習と神経科学の進歩が進むと考えています。 また、脳組織の特性を模倣し、単純な分散システムが複雑な情報の流れをどのように処理するかを学ぶことで、機械学習と神経科学のコミュニティを前進させたいと考えています。 これらの理由から、AI研究者と神経科学者の今後のコラボレーションにより、意識の理解が深まると楽観視しています。**未解決のフォローアップ:*** 1. LLMやAIにおける意識評価は、多くの場合、意識を検出するために言語ベースのテストに依存しています。 言語(テキスト)のみに基づいて意識を評価することは可能か、また、人工システムが意識的であるかどうかを判断するのに役立つさらなる評価機能はありますか?* 2. 哺乳類の意識の神経基盤は、視床皮質系に関連しています。 視床皮質系をAIに実装するには? 視床皮質系から恩恵を受ける具体的な機能やタスクは何ですか?* 3. 上行覚醒系は、生物の意識の生成にも重要な役割を果たしており、神経力学の形成において複雑かつ多面的な役割を果たしています。 AIは、覚醒システムの計算上の優位性を享受するために、これらの異なるプロセスをどの程度模倣する必要があるのでしょうか?* 4. 視床皮質系に加えて、樹状突起は、この記事で議論された意識の理論のいくつかにおいて重要な役割を果たします。 樹状突起は、生物学的ニューラルネットワークの計算の複雑さ/効率を高める要因の1つに過ぎないのでしょうか、それともそれ以上のものがあるのでしょうか?* 5. 生命システムの組織的複雑さは意識と関係があるのでしょうか? 生命システムは、互いに相互作用するさまざまなレベルの処理プロセスで構成されています。 生命システムの組織的複雑性は、より詳細に説明できるだろうか。 意識が生じる生物学的プロセスにもっと光を当てるために、そのようなシステムを扱うための新しい数学的枠組みは必要でしょうか?* 6. いくつかの理論は、意識とエージェンシーが密接に関連していることを示唆しています。 意識が生物活動からどのように生じるかを理解するには、まず行為主体性を理解する必要があるのでしょうか?**オリジナルリンク*** Aru, J., Larkum, M.E. and Shine, J.M. (2023b) 「神経科学のレンズを通した人工意識の実現可能性」, Trends in Neurosciences[Preprint] .DOI: 10.1016/j.tins.2023.09.009.

Cell誌が、AIが短期的に意識を生み出す可能性は低いと批判的に発表

元のソース: NextQuestion

大規模言語モデル(LLM)と対話すると、私たちは常に、それらが実際に意識しているのではないかという漠然とした感覚を持っています。 しかし、神経科学者の視点から見ると、この見解は持ちにくいようです。

Cell誌のサブジャーナル「Trends in Neurosciences」に掲載された最近の論文では、コンピューターサイエンス、生物学、神経科学の3人の研究者が、「人工知能は意識を生成できるのか」という疑問を掘り下げました。

結論として、彼らはLLMが現在の形では意識的になることができないことに同意します。 このような断定的な見方はどのようにして生まれたのでしょうか。

LLMと意識

どの動物が意識を持っているのか、動物以外のどの存在が意識を持っているのかは長い間疑問視されてきました。 最近のLLMの出現は、この問題にまったく新しい視点をもたらしました。 それは、私たちの会話能力(人間の意識の現れ)を示し、「理解」「知性」「意識」の3つの概念を再定義し、再考させます。

LLMは、人間同士の自然言語会話を含む数百億語のテキストデータでトレーニングされた数十億の接続重みを持つ、複雑で多層的な人工ニューラルネットワークです。 テキストで質問をすることで、ユーザーは魅力的なシミュレートされたコンテキストに引き込まれます。 時間をかけてこれらのシステムを使用する意思があれば、ネットワークの深さと品質に圧倒されずにはいられません。 それに質問をすると、その反応はしばしば、意識的な個人が生み出すことができるものと微妙に似ています。 したがって、洞察力に富み、意識的な個人として、私が受け取る答えは、同じく「意識的」であり、考え、感じ、推論し、経験することができる個人によって生成されたと結論付けるのは簡単です。 **

このような「チューリングテスト」の結果から、LLMはすでに意識を持っているのか、それともすぐに意識を持つようになるのか、疑問に思わずにはいられません。 しかし、この問いは、逆に「意識」覚醒の瀬戸際を繰り返すLLMを開発し続けることが倫理的かどうか、といった倫理的ジレンマの連続につながることになる。 LLMが「意識的」であるという考えは、今日の神経科学コミュニティでは普遍的に受け入れられているわけではありませんが、AIシステムの能力が向上し続けるにつれて、この考えの議論が必然的に前面に出てきています。 また、大手メディアでも広く議論されており、神経科学者は自らの専門的な視点から客観的に解釈するようになりました。

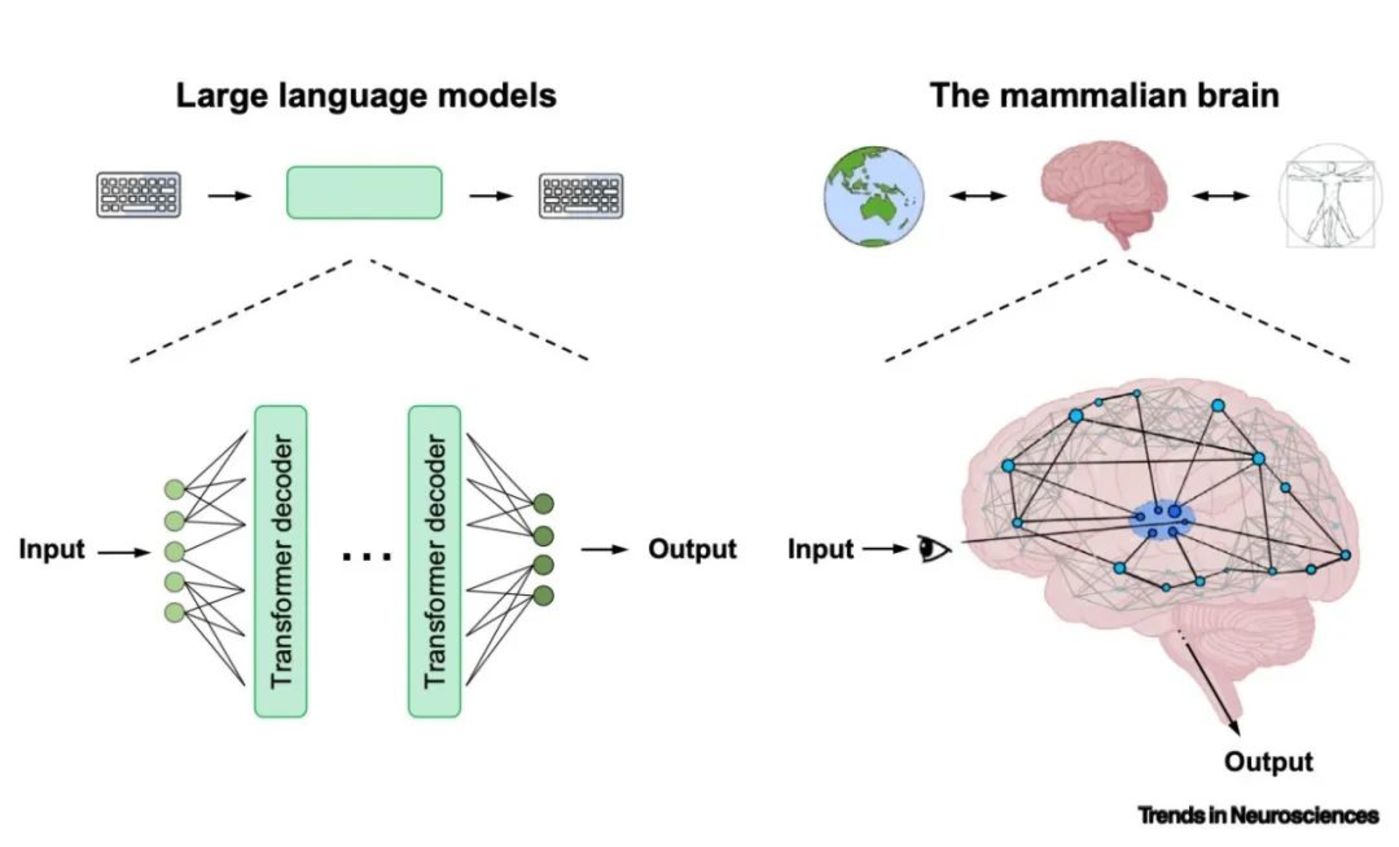

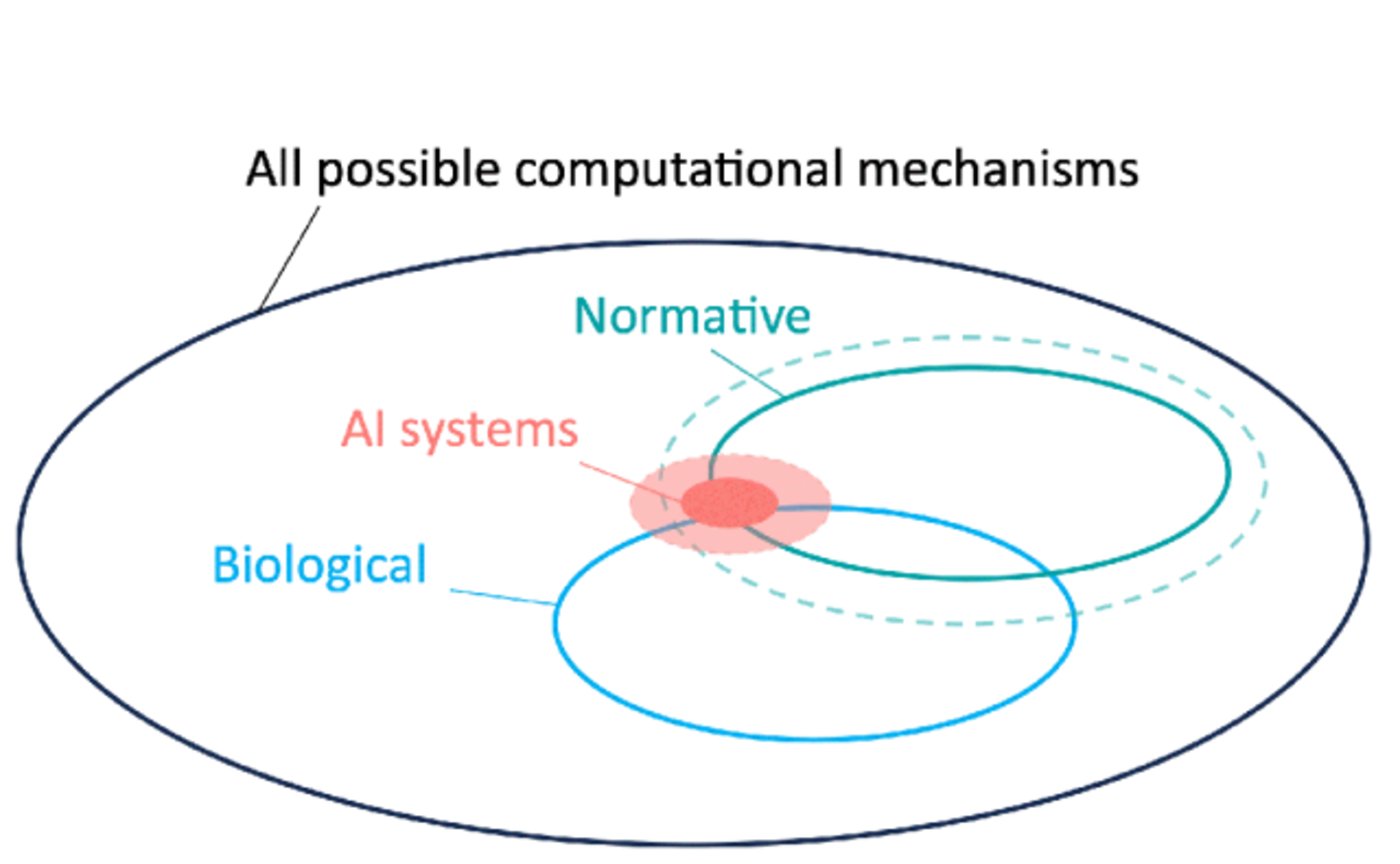

LLMが潜在的に意識的であるという考えは、LLMのアーキテクチャは脳の特性に大きく触発されており(図1)、脳は現時点で自信を持って「意識的」に帰することができる唯一の対象であるという重要な議論によってしばしば支持されています。 初期の人工ニューラルネットワークは、大脳皮質の簡略化されたバージョンに基づいて設計されましたが、現代のLLMは高度に設計され、特定の目的に適応しており、既知の脳構造との深い相同性を保持していません。 実際、LLMを計算能力の高いものにする経路の特徴の多く(図1)は、哺乳類の意識の生成と形成に因果関係を持つと現在考えられているシステムとは大きく異なるアーキテクチャを持っています。 例えば、意識生成に関する多くの神経科学理論は、視床皮質系と覚醒系が意識の処理において中心的な役割を果たしていることを示唆しているが、これらは現代のLLMでは利用できない。

この時点で、LLMのアーキテクチャが脳の特性を模倣することがそれほど重要なのか、と疑問に思う人もいるかもしれません。

私たちの意見では、主な理由は、複雑な身体に埋め込まれた脳から来る、現時点では1つの意識の存在しか確信できないことです。 厳密に言えば、この議論はさらに人間だけに絞り込まれるかもしれないが、主観的意識に重要な役割を果たすと考えられているシステムレベルの形質の多くは、哺乳類、さらには無脊椎動物にまで及ぶ生物学的スペクトル全体に広がっている。

そうは言っても、まず「意識」の正確な意味から始めましょう。 次に、現在のAIシステムが意識を持っている、または将来すぐに意識を持つという考えに反対する3つの議論を提示します。

**意識って何?

意識は複雑な概念であり、その定義は議論されてきました。 人間のコミュニケーション能力と相互作用能力の文脈では、コミュニケーションと対話の能力は、人が意識を持っているかどうかを評価するための本能的な要素です。

LLMとの言語ベースのインタラクティブな会話は、多くの場合、LLMが意識的である可能性が高いかどうかを判断するための出発点となる直感的な感覚を発達させます。 しかし、LLMはインタラクティブな会話に優れていますが、これは意識の正式な客観的尺度を満たしておらず、知能の予備的な証拠にすぎません。 **

LLMの出現により、人は他者との言語的相互作用から直接意識を生み出すことができるかどうかを再評価するようになりました。 したがって、人間らしい能力や人間らしい特性を判断する基準を改める必要があるという見方が新たになってきました。

「意識」という言葉には、しばしば異なる意味があります。 たとえば、神経科医はしばしば「意識レベル」に言及しますが、これは人が意識を持っているかどうかの最初の評価であり、次に意識のレベルまたは特定の状態をより詳細な方法で評価します。 一方、心理学者は、意識の内容、つまり個人の内なる世界の特定の経験、記憶、思考に関心があります。 また、意識の内容によって違いがあります。 私たちの経験は、現象的または経験的(例えば、リンゴを見たり匂いを嗅いだり、腕に触れたり)として説明することも、より抽象的な形(例えば、概念的記憶をどのように想像し、想像し、操作するか)で説明することができます。

AIシステムが意識を持っているかどうかという質問には、意識のいくつかの意味に焦点を当てることも、意識のすべての意味に同時に焦点を当てることもできます。 以下では、主に現象的認識に着目し、機械が世界を現象的に体験できるのかを探ります。

環境について

外界を知覚する過程で使用できる生物の部分は、その環境と呼ばれます。 たとえば、人間の網膜は380nm〜740nmの波長の光に反応します、つまり、網膜は青から赤までのスペクトルを知覚することができます。 外部技術の助けがなければ、人間はこの波長範囲外の赤外光(>740nm)や紫外線(<380nm)を検出することはできません。 また、聴覚、体性感覚、前庭感覚、すなわち、対応する聴覚領域(人間の耳は20Hz〜20,000Hzの音を聞くことができる)、体性感覚領域(人間は体の特定の部分から約1mm以内の刺激を識別できる)、および前庭領域(人間の三半規管の相互接続された3次元構造が内部の平衡感覚を提供する)という点でも同様の環境があります。 同時に、自然界の他の種は、電磁スペクトルの他の帯域の信号を検出することができます。 たとえば、ミツバチは紫外線範囲の光を見ることができ、ヘビは従来の視覚信号に加えて赤外線放射信号を検出できます。

つまり、動物が異なれば、体や脳が周囲を知覚できる感度も異なります。 アメリカの心理学者であるギブソンは、生物が特定の環境で行動する可能性を「アフォーダンス」と呼んでいます(インターネット技術の浸透に伴い、アフォーダンスは、メディアの実践や人間の日常の相互作用におけるデジタル技術の使用を説明するために使用され始めました)。 **

そのアルゴリズム設計の性質上、LLMはバイナリ符号化パターンのみを持ち、バイナリ情報入力のみを受信し、今日のLLMの作業アーキテクチャを構成する複雑なトランスフォーマー構造に固有のネットワークアルゴリズムをさらに実行することができます。 ニューロンスパイクは、入力アナログ信号をデジタル信号(バイナリ信号)に符号化することもできますが、LLMに伝達される情報の流れは非常に抽象的であり、外界自体との強いつながりはありません。 文字の羅列としてエンコードされたテキストや音声は、自然界の動的な複雑さに匹敵することはできず、つまり、LLMの環境(LLMに提供されるバイナリ情報)は、目を開けたり、会話を伝達したりしたときに脳に入る情報や、それに伴う経験とは根本的に異なります。 伝統的な哲学的言説は、異なる種間の情報の流れの独自性(例えば、人間とコウモリの違い)と、これらの経験の現象学的特徴を強調している。 LLMによって得られる情報入力は、当面の間、この違いを定量化する決定的な方法はありませんが、より有意な違いを示す可能性があると考えています。

そうは言っても、AIシステムのインプットは今後容赦なく豊かになっていくでしょう。 未来のLLMは、意識のあるエージェントが日常的にアクセスできる信号の種類(つまり、自然界からの統計)によりよく一致する、さまざまなタイプの入力を装備することができます。 では、将来のAIシステムの利用環境は、人間の環境よりも広いものになるのでしょうか。

この問いに答えるには、人間の潜在意識や意識的な経験は、感覚的なインプットだけでは決まらないことを認識しなければなりません。 例えば、私たちがポンツーンに横たわっているとき、通常の感覚体験がなくても、まだ意識があると想像してみてください。 ここでの概念は、環境が固有の主観的な視点、つまり主体から開始することを前提としていることが強調されています。 同様に、親近感は、被験者の内的性質、特に被験者の動機と目標に依存します。 つまり、意識は環境(LLMの入力データ)だけでは生成できないということです。 そのため、単に大量のデータをAIシステムに投入するだけでは、AIシステム自体を意識することはできません。 **

この視点は、意識の科学における基本的な仮定のいくつかを再考するよう促すかもしれません。 具体的には、AIシステムが次第に高度化していく中で、研究者は、ある種の意識理論が提唱する、より根源的な自己やエージェントに関連するプロセスが、意識の出現に必要であるかどうかを再評価する必要があります。

意識の「統合」

現在、意識の神経相関については多くの研究が行われていますが、その中でも意識処理の神経回路についてはさまざまな理論があります。 意識は、高密度で高度に接続された視床皮質ネットワークによって支えられていることを強調する人もいます。 **視床-皮質ネットワークには、皮質領域、皮質-皮質接合部、および高次視床核の皮質領域への分岐投射が含まれます。 視床皮質系のこの特定の構造は、意識と意識の統合を支える循環的で複雑な思考処理を支えています(つまり、意識は異なる脳領域から生じるという事実にもかかわらず、意識は統合されています)。 しかし、意識の統合を達成する方法について、理論が異なれば見解も異なります。

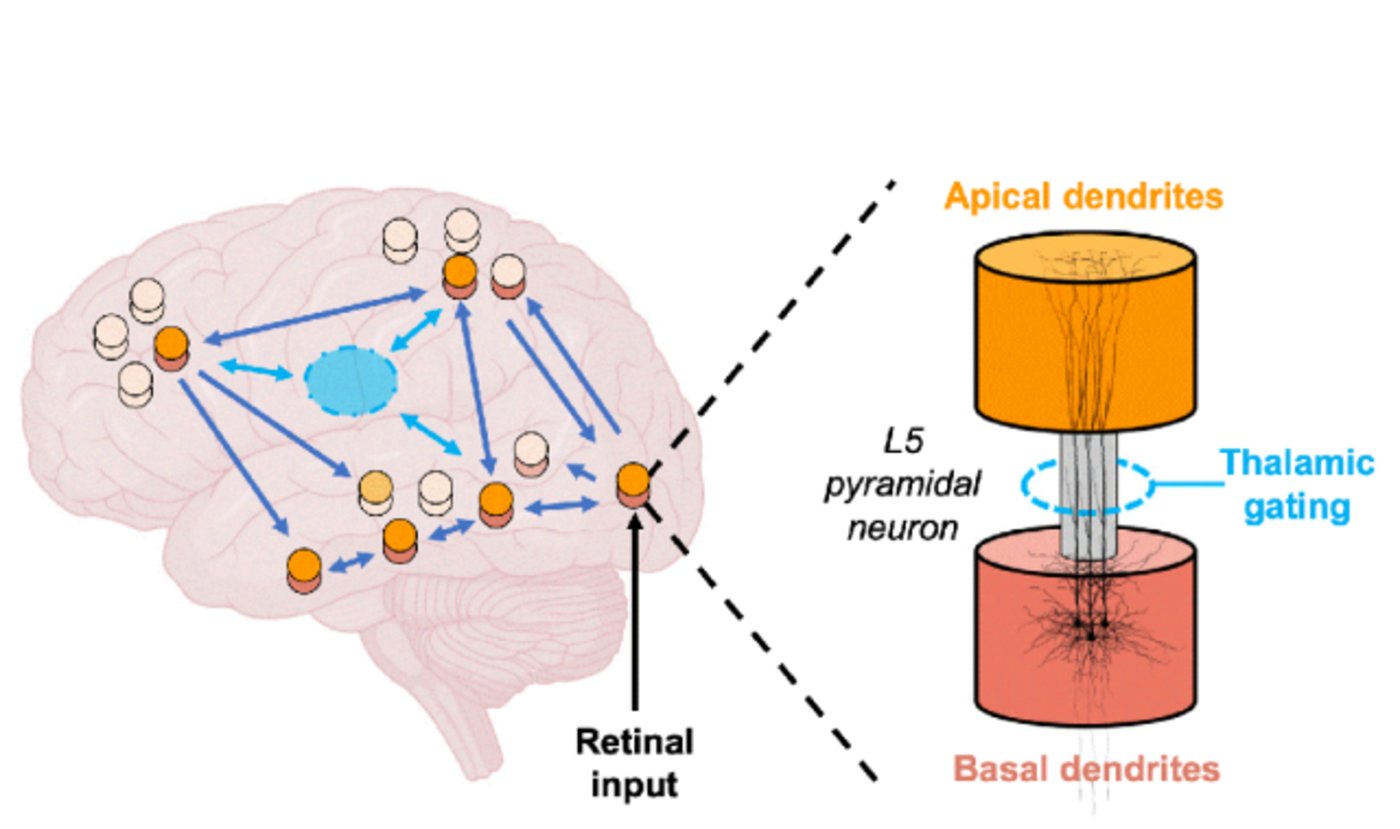

グローバルニューロンワークスペース理論(GNW)によると、意識は分散した前頭頂部皮質システムで構成される中央ワークスペースに依存しています。 このワークスペースは、局所皮質プロセッサからの情報を統合し、それを世界規模ですべての皮質局所プロセッサに送信し、意識的プロセスと無意識的プロセスを分離してグローバルに配信します。 他の意識理論では、意識的な統合は他の神経プロセスによって達成されると考えられています。 例えば、ニューロン樹状突起統合理論(DIT)は、意識的な統合は、異なる皮質領域間の高周波同期現象によって起こることを示唆しており、それは、関与する皮質領域に応じて、知覚、認知、運動計画などの異なる機能を含む可能性がある。

*キャプション:DIT理論(図2)では、研究者たちは、全体的な意識的統合は、視床-皮質回路と皮質回路の両方の中心にある大きな興奮性ニューロンである皮質の第5層の錐体ニューロンの局所統合にも依存すると考えています。 このタイプのニューロンには、まったく異なる種類の情報を処理する2つの主要な構造(図2、オレンジ色と赤色の円柱)があり、基底構造(赤)は外部の基本情報を処理し、頂端構造(オレンジ色)は内部で生成された情報を処理します。 DIT理論によると、意識状態では、これら2つの構造が互いに結合し、情報が視床-皮質および皮質-皮質回路を流れることを可能にし、情報と意識生成のシステム全体の統合を可能にします。 *

現在のLLMやその他のAIシステムのアーキテクチャには、これらの理論が強調する特徴が欠けていることに注意することが重要です:既存のLLMは、同等の二構造錐体ニューロンも、中央集権的な視床アーキテクチャも、グローバルワークスペースも、上行覚醒システムの複数の特徴も持っていません。 言い換えれば、既存のAIシステムには、現在、神経科学界で意識生成の基盤として信じられている脳の特徴が欠けているのです。 哺乳類の脳は意識の生成をサポートできる唯一の構造ではないが、神経生物学の証拠は、哺乳類の意識の形成は非常に特殊な構造原理(すなわち、統合されたニューロンと興奮したニューロンの間の単純な接続)によって決定されることを示唆している。 トポロジー的には、既存のAIシステムの構造は極めて単純であり、それが既存のAIシステムを現象認識とは見なさない理由の1つです。

では、未来のAIモデルは、多くの意識理論が核としている「統合」のプロセスを、ついに統合できるようになるのでしょうか。 この問題に対して、GNW理論が提唱する「統合」という概念は、比較的簡便に実装できる方法である。 実際、最近のAIシステムの中には、ローカルプロセッサが共有するグローバルワークスペースのようなものに組み込まれているものもあります。 グローバル送信の計算処理はAIシステムに実装できるため、この理論によれば、この計算方法を採用したAIシステムには、潜在的な意識の中核的なコンポーネントが含まれていることになります。

しかし、前述したように、すべての意識理論が、この統合の様式が意識の生成の鍵であることに同意しているわけではありません。 例えば、意識の統合情報理論は、現代のコンピュータは情報を完全に統合するために必要な因果推論能力を達成するための適切なアーキテクチャを備えていないため、典型的な現代のコンピュータに実装されたソフトウェアベースのAIシステムは意識を持つことができないと主張しています。 そこで、第3の可能性として、意識は原理的には達成可能であるが、AIシステムの現在(そしておそらく将来)の計算特異性のレベルを超える必要があるかもしれないという可能性について考えます。 **

意識は複雑な生物学的プロセスである

意識の生成は、システムのアーキテクチャだけに依存しているわけではありません。 例えば、深い睡眠や麻酔をしているとき、視床皮質系の構造は変化しませんが、意識は消えます。 深い睡眠時でも、主要な感覚野における局所的な神経反応とガンマベルト活動は、意識状態のものと類似しています。 これは、意識が特定の神経プロセスに依存していることを示唆していますが、これらの神経プロセスは意識脳と無意識脳で異なります。 **

意識的処理と無意識的処理の詳細な違いを明らかにするために、まずニューロン樹状突起統合(DIT)の理論に戻りましょう。 DIT理論には、意識的および無意識的に処理される神経プロセスに関連する多くの神経生物学的ニュアンスが含まれています。 DIT理論は、意識的処理と無意識的処理の主な違いは、錐体細胞の2つの区画構造の統合にあると提唱しています(図2)。 前述したように、意識的な処理の間、これら2つの構造は互いに相互作用し、視床皮質系全体が複雑な情報を処理および統合することを可能にします。 しかし、麻酔状態では、様々な麻酔薬が椎体ニューロンの2つの構造間の機能的デカップリングをもたらす。 言い換えれば、これらの脊椎ニューロンは解剖学的には無傷であり、活動電位を励起することができますが、樹状突起統合能力は生理学的に著しく制限されており、トップダウンフィードバックは処理に影響を与えることができません。 研究によると、この樹状突起結合は代謝型受容体によって制御されていますが、この構造は計算モデルや人工ニューラルネットワークでは見落とされがちです。 さらに、研究は、この場合、より高い視床核がこの代謝性受容体の活性を制御することを示している。 したがって、特定の神経生物学的プロセスが、脳内の意識の「オン」と「オフ」に関与している可能性があります。 このことは、哺乳類の脳における経験の質が、意識を生み出す根本的なプロセスと複雑な関係にあることを示唆している。 **

これらの理論は十分に説得力がありますが、意識の完全な理解から生じる神経プロセスの複雑さと比較すると、この知識が見劣りすることはほぼ確実です。 現在の意識の説明は、グローバルワークスペース、統合情報、循環処理、樹状突起統合などの理論に依存していますが、真の意識が生じる生物学的プロセスは、これらの理論で現在理解されているよりもはるかに複雑である可能性があります。 現在、意識研究の議論を構成するために使われている抽象的な計算レベルの考え方は、意識を説明するために必要な計算の詳細を完全に考慮していない可能性さえあります。

言い換えれば、生物学は複雑であり、バイオコンピューティングの現在の理解は限られているため(図3)、意識を理解するための適切な数学的および実験的ツールが不足している可能性があります。 **

*キャプション:DIT理論(図2)では、研究者たちは、全体的な意識的統合は、視床-皮質回路と皮質回路の両方の中心にある大きな興奮性ニューロンである皮質の第5層の錐体ニューロンの局所統合にも依存すると考えています。 このタイプのニューロンには、まったく異なる種類の情報を処理する2つの主要な構造(図2、オレンジ色と赤色の円柱)があり、基底構造(赤)は外部の基本情報を処理し、頂端構造(オレンジ色)は内部で生成された情報を処理します。 DIT理論によると、意識状態では、これら2つの構造が互いに結合し、情報が視床-皮質および皮質-皮質回路を流れることを可能にし、情報と意識生成のシステム全体の統合を可能にします。 *

生物学的複雑さをよりよく理解するためには、細胞レベルおよび全身レベルでの上記の生物学的プロセスは生体内で発生しなければならず、不可分であることを強調することが重要です。 生物は、現在の機械やAIアルゴリズムとは異なり、常に異なる処理レベルで自分自身を維持することができます。 また、生命システムは多面的な進化・発展の歴史を持ち、その存在は複数の組織レベルでの活動に依存しています。 意識は生命システムの組織化と複雑に結びついています。 しかし、今日のコンピュータは、この生きたシステムの組織的な複雑さ(つまり、システムの異なるレベル間の相互作用)を具現化することができていないことは注目に値します。 これは、最新のAIアルゴリズムには組織レベルの制約がなく、生きたシステムほど効果的に機能しないことを示唆しています。 つまり、AIがソフトウェアベースである限り、意識的でインテリジェントな存在には適さない可能性があるということです。 **

生物学的複雑性の概念は、細胞レベルでも表現できます。 生物学的ニューロンは、数行のコードで完全にキャプチャできる単なる抽象的なエンティティではありません。 対照的に、生物学的ニューロンは多層的な組織を持ち、ニューロン内の複雑な生物物理学的プロセスのさらなるカスケードに依存しています。 例えば、細胞呼吸の基本であり、細胞の恒常性を維持するための重要なプロセスである「クレブス回路」を例にとります。 細胞呼吸は、細胞が有機分子に蓄えられたエネルギーを細胞が利用できるエネルギーの形に変換することを可能にする重要な生物学的プロセスです。 しかし、細胞呼吸などの生物物理学的プロセスは実際の物理分子に基づいている必要があるため、このプロセスをソフトウェアに「圧縮」することはできません。 もちろん、これは意識に「クレブス・サイクル」が必要だという意味ではなく、意識を理解するプロセスにも同様の課題が絡んでいるかもしれないこと、つまり、意識は根底にあるメカニズムから切り離すことができないということを強調している。 **

しかし、意識は知能システムによって全く生成できないという主張に完全には賛同できませんが、意識と生命の背後にある複雑な生物学的組織との相関関係を考慮する必要があり、意識の本質を捉える計算の種類は、現在の理論が理解しているよりもはるかに複雑である可能性があります(図3)。 意識の「生検」を行い、それを組織から取り除くことはほとんど不可能です。 この見解は、意識は抽象的な計算レベルで生じうるという、意識に関する現在の多くの理論と矛盾する。 意識を完全に理解するためには、生命システムに見られるクロススケールの相互依存性と組織の複雑さを無視することはできません。 **

AIシステムは、ネットワークコンピューティングのレベルで生物学的なシステムを模倣しているが、これらのシステムでは、脳内の意識と密接な因果関係を持つプロセスから、他のすべてのレベルの生物学的プロセスが抽象化されているため、既存のAIシステムは意識そのものを抽象化している可能性がある。 その結果、LLMと未来のAIシステムは、シミュレートされた意識の特徴の無限の流れに閉じ込められる可能性がありますが、現象的な意識は存在しません。 もし意識が本当にこれらの他のレベルの処理、あるいは異なるスケール間の相互作用に関係しているのなら、機械が意識を生成する可能性からはほど遠いことになります。

まとめ

本稿では、LLMにおける意識の可能性や、未来のAIシステムを神経科学的な視点から探ります。 LLMは魅力的ですが、意識的ではなく、将来の短期間は意識的ではありません。

まず、哺乳類の環境(哺乳類が知覚できる外界の「ごく一部」)とLLMの非常に貧しく限られた環境との大きな違いを説明します。 第二に、LLMのトポロジーは非常に複雑であるが、経験的には哺乳類の意識関連回路の神経生物学的詳細とは大きく異なっており、したがってLLMが現象的な意識を生成できると考える正当な理由はないと主張する(図1)。 生命システムに内在するが、AIシステムには明らかに存在しない生物学的組織の複雑さから意識を抽象化することは、まだ不可能です。 全体として、上記の3つの重要なポイントにより、LLMは現在の形では意識的になることは不可能です。 それらは、意識的な経験の豊かさを説明するために使用される人間の自然言語コミュニケーションの特徴を模倣しているだけです。

この記事を通じて、提示された議論が単なる異議を表すのではなく、何らかの肯定的な影響と反省をもたらすことを願っています(未解決の質問を参照)。 第一に、LLMの認識された能力に関する現在の潜在的な倫理的懸念は、現実よりも仮説です。 さらに、LLMと哺乳類の脳トポロジーの類似点と相違点をより深く理解することで、機械学習と神経科学の進歩が進むと考えています。 また、脳組織の特性を模倣し、単純な分散システムが複雑な情報の流れをどのように処理するかを学ぶことで、機械学習と神経科学のコミュニティを前進させたいと考えています。 これらの理由から、AI研究者と神経科学者の今後のコラボレーションにより、意識の理解が深まると楽観視しています。

未解決のフォローアップ:

オリジナルリンク