¿Cómo funciona Dolphin Network? Análisis detallado del proceso de inferencia de IA descentralizado.

El desarrollo acelerado de modelos de IA está impulsando una fuerte demanda global de GPU. A medida que los grandes modelos de lenguaje (LLM), los agentes de IA y las aplicaciones de automatización crecen, las plataformas de nube centralizadas de IA enfrentan cada vez más desafíos de costos elevados, concentración de recursos y presión de escalabilidad. En este contexto, las redes descentralizadas de GPU se consolidan como una vía clave para la infraestructura de IA Web3.

Dolphin Network es una red de inferencia de IA desarrollada para responder a esta tendencia. Su objetivo principal es reunir recursos GPU distribuidos globalmente en una infraestructura de IA abierta y coordinar desarrolladores, nodos GPU y la red mediante el mecanismo de incentivos POD.

¿Cuál es la estructura central de Dolphin Network?

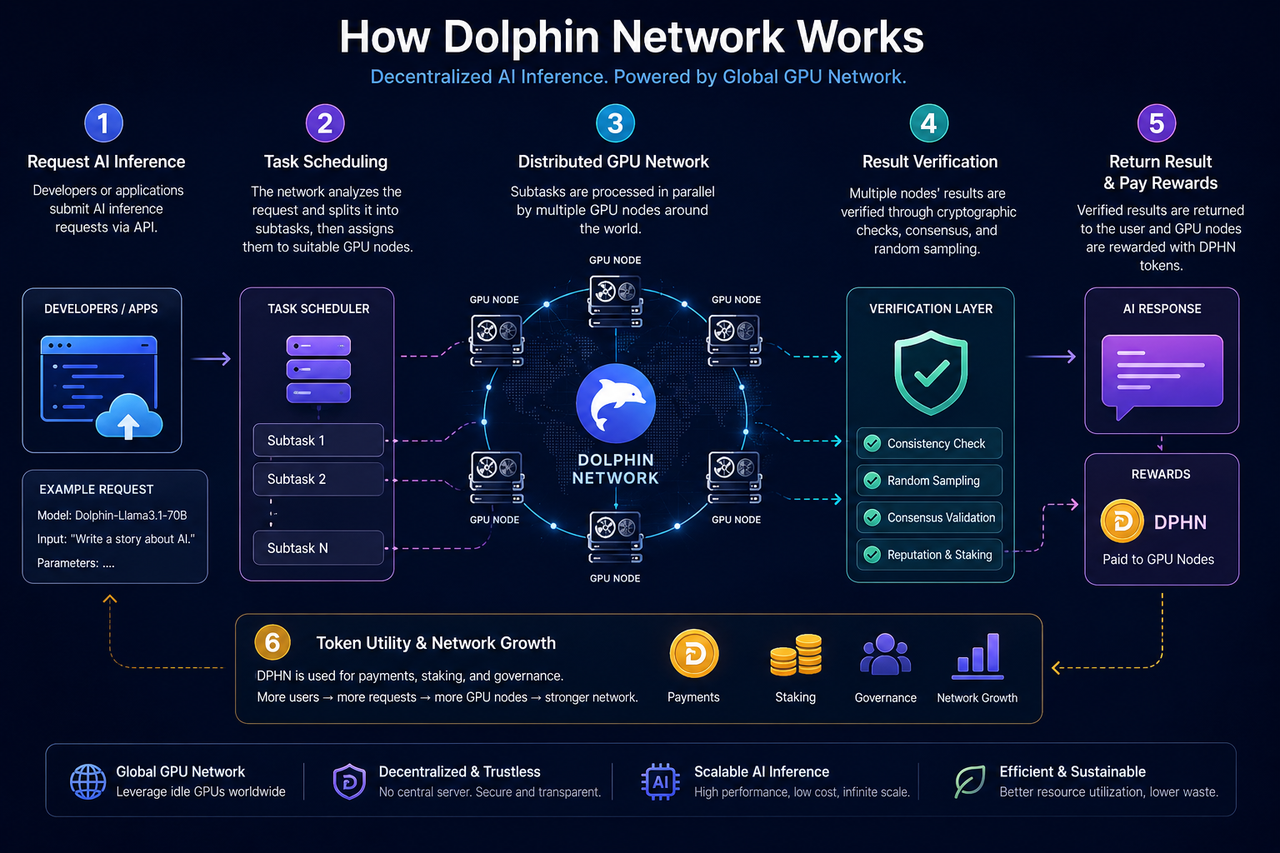

La arquitectura central de Dolphin Network se compone de tres elementos: solicitantes de inferencia de IA, la red de nodos GPU y un sistema de verificación-coordinación.

Los desarrolladores o aplicaciones pueden enviar solicitudes de inferencia de IA—como generación de texto, inferencia de chat, invocación de modelos o tareas de agente de IA—a la red. El sistema asigna dinámicamente las solicitudes a los nodos adecuados según el estado de los nodos GPU, los requisitos de la tarea y la disponibilidad de recursos.

Los nodos GPU son aportados por usuarios globales. Los participantes pueden unirse a la red con GPU inactivas, ejecutar tareas de inferencia localmente y obtener recompensas en tokens según su contribución.

Para garantizar la integridad de los resultados, Dolphin utiliza mecanismos de verificación y económicos para coordinar el comportamiento de los nodos, incluyendo muestreo aleatorio, revisión de tareas y sistemas de staking.

¿Cómo ingresan las solicitudes de inferencia de IA a la red?

Cuando un desarrollador interactúa con Dolphin Network, las solicitudes se enrutan primero a la capa de programación de tareas.

Esta capa analiza el tipo de tarea, los requisitos de GPU y los recursos del modelo. Los diferentes modelos de IA pueden requerir configuraciones de memoria, velocidades de inferencia y potencia de cómputo distintas, por lo que la red asigna dinámicamente las solicitudes a los nodos según su estado.

En plataformas de nube centralizada de IA, este proceso lo gestiona un único centro de datos. En Dolphin, las tareas se distribuyen en una red descentralizada de nodos GPU.

Algunas tareas pueden dividirse en solicitudes de inferencia más pequeñas para maximizar la eficiencia y la concurrencia de la red.

¿Cómo procesan los nodos GPU las tareas de inferencia de IA?

Los nodos GPU son los principales recursos de cómputo de Dolphin Network.

Los operadores de nodos instalan software específico y permiten que el sistema utilice sus GPU locales para tareas de inferencia de IA. Cuando se asigna una tarea, el nodo descarga el modelo o los parámetros de inferencia necesarios y realiza el cálculo localmente.

Al terminar, el nodo envía los resultados de la inferencia a la red y espera la verificación para confirmar su validez. Solo las tareas que superan la verificación pueden recibir recompensas en tokens.

Este enfoque difiere de la minería tradicional de GPU. Mientras que las redes PoW se enfocan en cálculos de hash, los nodos GPU de Dolphin ejecutan tareas reales de inferencia de IA, acercándose a un “mercado de potencia de hash disponible”.

¿Cómo verifica Dolphin los resultados de inferencia de IA?

La inferencia de IA se diferencia de las transacciones blockchain estándar, ya que los resultados no suelen validarse mediante fórmulas matemáticas simples. Por eso, Dolphin recurre a mecanismos adicionales para evitar que los nodos envíen resultados incorrectos.

Una práctica habitual es el muestreo aleatorio—se seleccionan tareas al azar para revisión y se confirma la consistencia entre varios nodos. Si un nodo envía datos anómalos de forma recurrente, puede perder reputación o quedar inhabilitado para recibir recompensas.

Algunas redes de IA descentralizadas también emplean staking. Los nodos deben poner tokens en staking para participar, y las acciones maliciosas pueden generar sanciones sobre sus activos en staking.

Estos incentivos económicos buscan alinear el comportamiento de los nodos y fortalecer la credibilidad de la red.

¿En qué se diferencia Dolphin de la inferencia en la nube tradicional de IA?

Las plataformas tradicionales de nube de IA dependen de grandes centros de datos centralizados—un solo actor controla los clústeres de GPU, el despliegue de modelos y los servicios API.

Dolphin utiliza una arquitectura de red de GPU abierta. Los nodos GPU provienen de usuarios globales, lo que permite a los desarrolladores acceder a servicios de inferencia de IA en un entorno abierto y reduce la dependencia de un proveedor único.

Dolphin también apuesta por modelos de IA abiertos y el intercambio de recursos. Algunas redes permiten el despliegue de modelos open-source, reglas de sistema personalizadas y escenarios abiertos de agentes de IA.

Sin embargo, las redes de IA distribuidas enfrentan retos como estabilidad, latencia de red y variabilidad en la calidad de los nodos, por lo que siguen en fases iniciales de desarrollo.

¿Qué desafíos enfrenta Dolphin Network?

Las redes descentralizadas de inferencia de IA ofrecen apertura e intercambio de recursos, pero afrontan varios desafíos prácticos.

En primer lugar, el rendimiento de los nodos GPU es muy variable. Las diferencias en memoria, ancho de banda y capacidad de inferencia afectan la estabilidad de la red.

En segundo lugar, la verificación de resultados de IA es compleja. A diferencia de las transacciones blockchain, las salidas de IA son probabilísticas y elevan los costos de verificación.

A medida que los modelos de IA crecen, la programación eficiente de clústeres GPU a gran escala en entornos distribuidos es un reto crítico para los proyectos DePIN de IA.

La incertidumbre regulatoria también influye. Los modelos de IA abiertos pueden generar inquietudes sobre datos, derechos de autor y generación de contenido, por lo que las redes de infraestructura de IA deben gestionar riesgos regulatorios a largo plazo.

Resumen

Dolphin Network es una red descentralizada de inferencia de IA que combina IA y DePIN, y busca construir infraestructura de IA abierta con nodos GPU globales. La red coordina desarrolladores y nodos GPU mediante programación de tareas, inferencia distribuida, verificación aleatoria y el mecanismo de incentivos DPHN.

Frente a las plataformas tradicionales de nube centralizada de IA, Dolphin prioriza la apertura, el intercambio de recursos y la resistencia a la censura, posicionándose como una referencia clave para la infraestructura de IA Web3.

Preguntas frecuentes

¿Cómo utiliza Dolphin los nodos GPU?

Los holders de GPU pueden desplegar nodos y aportar recursos GPU inactivos para ejecutar tareas de inferencia de IA y obtener recompensas DPHN.

¿Qué etapas incluye el proceso de inferencia de IA en Dolphin?

Las fases principales son: envío de tareas, programación de nodos, ejecución de inferencia GPU, verificación de resultados y distribución de recompensas.

¿Por qué Dolphin se considera un proyecto DePIN?

Sus recursos centrales son hardware GPU real y coordina infraestructura distribuida mediante incentivos basados en tokens.

¿En qué se diferencia Dolphin de las plataformas tradicionales de nube de IA?

Las plataformas tradicionales de nube de IA dependen de centros de datos centralizados; Dolphin utiliza una red de GPU abierta para ofrecer servicios de inferencia de IA distribuidos.

¿Cuál es la función de DPHN en la red?

DPHN se emplea para pagos de inferencia de IA, recompensas de nodos, staking y como incentivo económico dentro de la red.

Artículos relacionados

Tokenómica de RENDER: suministro, incentivos y captura de valor

La aplicación de Render en IA: cómo el hashrate descentralizado impulsa la inteligencia artificial

0x Protocol vs Uniswap: ¿Cómo se diferencian los protocolos de Libro de órdenes del modelo AMM?

Análisis en profundidad de Audiera GameFi: cómo Dance-to-Earn integra la IA con los juegos de ritmo

GateClaw y habilidades de IA: análisis detallado del marco de capacidades para agentes de IA en Web3