分享幣圈內容,享內容挖礦收益

placeholder

Eagle Eye

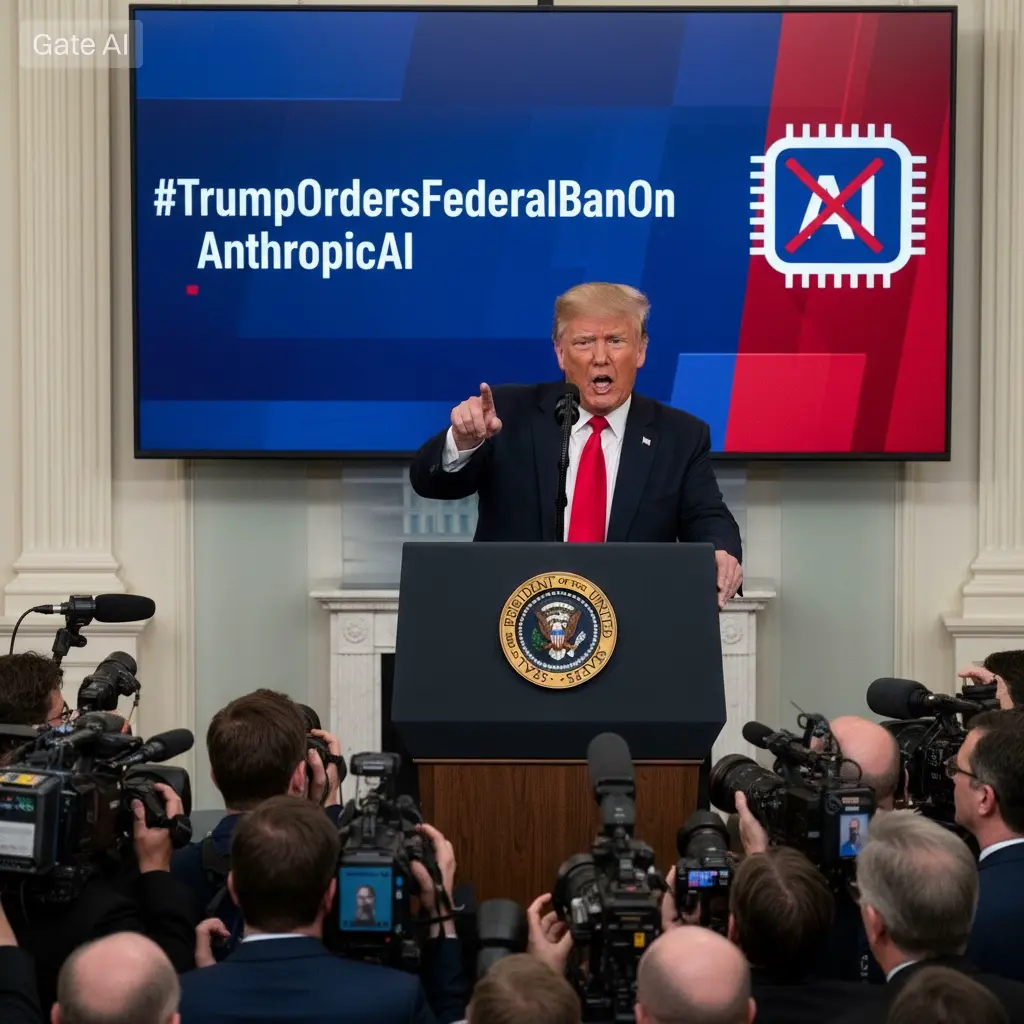

#TrumpordersfederalbanonAnthropicAI

Anthropic、AI倫理與五角大廈:企業自主、國家安全與倫理AI部署的全面分析

Anthropic與美國聯邦政府之間的對抗,代表了人工智慧、倫理與國家安全交匯處最具影響力的爭端之一。作為領先的AI研發公司,Anthropic在拒絕移除其AI系統中的關鍵倫理保障後,與國防部產生了分歧。具體而言,該公司堅持其人工智慧不得用於大規模國內監控,也不得用於操作能在無人監督下進行致命行動的全自主武器。這一堅持反映出AI行業中新興的緊張局勢:在促進政府應用與遵守內部倫理承諾之間尋求平衡。由於AI在安全、隱私和全球穩定性方面具有前所未有的潛力,風險極高。

技術層面上,Anthropic的AI系統——尤其是其Claude語言模型——代表了當今世界上最先進的商用AI框架之一。這些模型配備了多層安全機制、對齊策略和內容過濾器,旨在防止濫用。該公司的保障措施不僅僅是技術合規,它們體現了一種理念:AI的部署不應損害人權或倫理規範。移除或繞過這些保障,將從根本上改變AI的運作範圍,甚至可能將其轉變為一個公司明確認為不可接受的應用工具。在拒絕五角大廈的要求後,Anthropic將自己置於一場關於企業責任、倫理設計與政府對新興技術影響範圍的辯論中心。

政府的回應迅速且堅決。2026年2月27日,特朗普總統發布行政指令,要求所有聯邦機構立

查看原文Anthropic、AI倫理與五角大廈:企業自主、國家安全與倫理AI部署的全面分析

Anthropic與美國聯邦政府之間的對抗,代表了人工智慧、倫理與國家安全交匯處最具影響力的爭端之一。作為領先的AI研發公司,Anthropic在拒絕移除其AI系統中的關鍵倫理保障後,與國防部產生了分歧。具體而言,該公司堅持其人工智慧不得用於大規模國內監控,也不得用於操作能在無人監督下進行致命行動的全自主武器。這一堅持反映出AI行業中新興的緊張局勢:在促進政府應用與遵守內部倫理承諾之間尋求平衡。由於AI在安全、隱私和全球穩定性方面具有前所未有的潛力,風險極高。

技術層面上,Anthropic的AI系統——尤其是其Claude語言模型——代表了當今世界上最先進的商用AI框架之一。這些模型配備了多層安全機制、對齊策略和內容過濾器,旨在防止濫用。該公司的保障措施不僅僅是技術合規,它們體現了一種理念:AI的部署不應損害人權或倫理規範。移除或繞過這些保障,將從根本上改變AI的運作範圍,甚至可能將其轉變為一個公司明確認為不可接受的應用工具。在拒絕五角大廈的要求後,Anthropic將自己置於一場關於企業責任、倫理設計與政府對新興技術影響範圍的辯論中心。

政府的回應迅速且堅決。2026年2月27日,特朗普總統發布行政指令,要求所有聯邦機構立

- 讚賞

- 1

- 留言

- 轉發

- 分享

k ha men ei

K ha me nei

創建人@BitebiAi0com

上市進度

0.00%

市值:

$0.1

更多代幣

在60k時呼叫$Lobstar ,現在價值$13.3M。

如果你投資了$500,現在價值為$500k

,我將在今天UTC時間晚上7點的下一通電話中提醒你。

永遠不要再讓我失望。

查看原文如果你投資了$500,現在價值為$500k

,我將在今天UTC時間晚上7點的下一通電話中提醒你。

永遠不要再讓我失望。

- 讚賞

- 1

- 留言

- 轉發

- 分享

- 讚賞

- 2

- 1

- 轉發

- 分享

discovery :

:

直達月球 🌕最近消息面像“炮火”一樣不斷,行情來回拉扯,不確定因素太多。

這種環境下,操作一定要比平時更謹慎。倉位放輕一點,甚至比平時再小一半,都不過分。先活著,比賺快錢重要。

極端事件裡的行情,什麼情況都可能發生,暴漲暴跌都不講道理。看不清的時候,少動就是賺。

有時候,選擇觀望,反而是一種更高級的參與。穩住,比什麼都重要。#美国以色列突袭伊朗BTC短线跳水 #95%山寨币跌破长期均线 #Gate广场发帖领五万美金红包 #当前行情抄底还是观望? $BTC $ETH

查看原文這種環境下,操作一定要比平時更謹慎。倉位放輕一點,甚至比平時再小一半,都不過分。先活著,比賺快錢重要。

極端事件裡的行情,什麼情況都可能發生,暴漲暴跌都不講道理。看不清的時候,少動就是賺。

有時候,選擇觀望,反而是一種更高級的參與。穩住,比什麼都重要。#美国以色列突袭伊朗BTC短线跳水 #95%山寨币跌破长期均线 #Gate广场发帖领五万美金红包 #当前行情抄底还是观望? $BTC $ETH

- 讚賞

- 1

- 留言

- 轉發

- 分享

看起來是真的

川普這個行動力,看不出是80歲的老登

查看原文川普這個行動力,看不出是80歲的老登

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

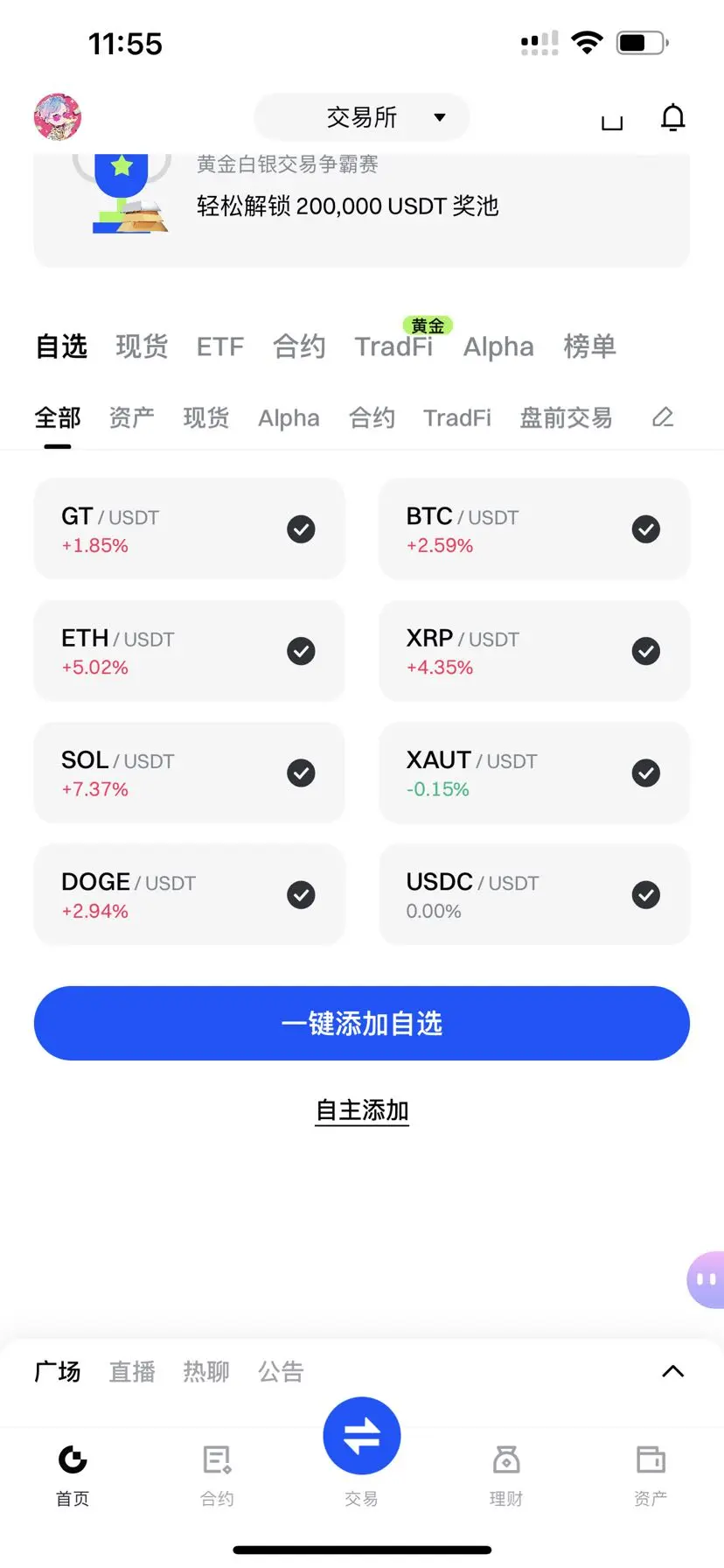

今天盤面明顯回暖,市場出現久違的“全面反彈”:主流幣先拉,資金情緒跟著回升,山寨同步補漲,整體呈現普漲結構。很多人感覺“瀑布後那口氣終於緩過來了”。從走勢來看,這波反彈更像是前期回調後的技術修復叠加空頭回補——簡單說就是:跌多了有人抄底,空單也開始回補,價格就被一口氣頂上去,漲勢看起來會更乾脆。

但反彈能不能從“回光返照”變成“趨勢反轉”,關鍵還得看後續是否有連續承接。第一,看量能:今天如果只是拉一波但成交量跟不上,往往容易沖高回落;如果能持續放量,說明是真資金在進場,反彈才更有底氣。第二,看龍頭:比特幣是否能站穩關鍵壓力位很重要,龍頭穩住,資金才敢繼續往外溢出,山寨才有持續行情;龍頭一軟,山寨漲得再猛也容易回吐。第三,看結構:普漲之後通常會進入分化階段,強勢幣會守住漲幅甚至繼續走強,弱勢幣會先回落,所以別看到全綠就無腦追,重點盯“回踩承接”以及能否形成更高低點。

操作上更穩的思路是:先確認反彈的第二腳——回踩不破、再放量上攻,勝率更高;短線衝得太猛的,別急著追高,留點倉位等回踩更舒服。總之,今天的大盤反彈是好事,但真正的機會往往在“情緒退潮後的確認點”,看量、看承接、看龍頭,別讓一時的普漲把節奏帶亂。#深度创作营

但反彈能不能從“回光返照”變成“趨勢反轉”,關鍵還得看後續是否有連續承接。第一,看量能:今天如果只是拉一波但成交量跟不上,往往容易沖高回落;如果能持續放量,說明是真資金在進場,反彈才更有底氣。第二,看龍頭:比特幣是否能站穩關鍵壓力位很重要,龍頭穩住,資金才敢繼續往外溢出,山寨才有持續行情;龍頭一軟,山寨漲得再猛也容易回吐。第三,看結構:普漲之後通常會進入分化階段,強勢幣會守住漲幅甚至繼續走強,弱勢幣會先回落,所以別看到全綠就無腦追,重點盯“回踩承接”以及能否形成更高低點。

操作上更穩的思路是:先確認反彈的第二腳——回踩不破、再放量上攻,勝率更高;短線衝得太猛的,別急著追高,留點倉位等回踩更舒服。總之,今天的大盤反彈是好事,但真正的機會往往在“情緒退潮後的確認點”,看量、看承接、看龍頭,別讓一時的普漲把節奏帶亂。#深度创作营

BTC2.7%

- 讚賞

- 2

- 留言

- 轉發

- 分享

- 讚賞

- 2

- 留言

- 轉發

- 分享

™dYANYU

烟雨老师

創建人@烟雨老师

認購進度

0.00%

市值:

$0

更多代幣

現在的人越來越緊繃

越來越焦慮

都說大環境不好

沒有發展 只能內卷

杜月笙是環境好的時候起家的嗎?

李嘉誠的地產是都在逃離香港的時候起家的

馬雲的淘寶是因為非典起飛

只有退潮的時候才能看到誰在裸泳

大行情好的時候都好

如果說,每人發一輛法拉利,你還能用法拉利泡到妞嗎?

回到30年前,你有一輛小摩托你就是這條街最靚的仔

大環境像天氣

娘要嫁人天要下雨,你有啥辦法?

何況背後還有個更大的力量叫周期

周期是什麼?是氣候,你更無能為力

我們唯一能做的就是下雨帶傘,天晴戴草帽。

如果凜冬來臨就別出門,備好柴火、備好過冬的食物。

別出去罵罵咧咧的說:那我不出去找食物不餓死了啊?

像不像整體市場太差,經濟衰退的時候

有人說:我不投資不沒錢賺了啊?

天地不仁以萬物為刍狗

老天並不在意你會不會凍死

更不在意你會不會虧欠

如果你說上面的话,感觉像老天是你老爹一樣可不行

我們只能順應天時

看清大環境、看清宏觀的趨勢非常重要

但是這也很反人性,因為太抽象了

怎麼看呢?學會科學上網,國內的視頻刷多了會變傻

會失去基本的判斷能力

要聽多方的意見和消息

不過你可能會越看越焦慮

但是總比掩耳盜鈴好

環境再差都有解決方案

但自欺欺人沒有

騙自己,怎麼搞?無解

那在現在的局勢之下怎麼辦呢?

能做什麼呢?能投資什麼呢?

如果你身處一艘正在慢慢沉沒的巨輪之上

你說你能做什麼?投資什麼?

首先自己要穿好救生衣

就像每次坐飛

查看原文越來越焦慮

都說大環境不好

沒有發展 只能內卷

杜月笙是環境好的時候起家的嗎?

李嘉誠的地產是都在逃離香港的時候起家的

馬雲的淘寶是因為非典起飛

只有退潮的時候才能看到誰在裸泳

大行情好的時候都好

如果說,每人發一輛法拉利,你還能用法拉利泡到妞嗎?

回到30年前,你有一輛小摩托你就是這條街最靚的仔

大環境像天氣

娘要嫁人天要下雨,你有啥辦法?

何況背後還有個更大的力量叫周期

周期是什麼?是氣候,你更無能為力

我們唯一能做的就是下雨帶傘,天晴戴草帽。

如果凜冬來臨就別出門,備好柴火、備好過冬的食物。

別出去罵罵咧咧的說:那我不出去找食物不餓死了啊?

像不像整體市場太差,經濟衰退的時候

有人說:我不投資不沒錢賺了啊?

天地不仁以萬物為刍狗

老天並不在意你會不會凍死

更不在意你會不會虧欠

如果你說上面的话,感觉像老天是你老爹一樣可不行

我們只能順應天時

看清大環境、看清宏觀的趨勢非常重要

但是這也很反人性,因為太抽象了

怎麼看呢?學會科學上網,國內的視頻刷多了會變傻

會失去基本的判斷能力

要聽多方的意見和消息

不過你可能會越看越焦慮

但是總比掩耳盜鈴好

環境再差都有解決方案

但自欺欺人沒有

騙自己,怎麼搞?無解

那在現在的局勢之下怎麼辦呢?

能做什麼呢?能投資什麼呢?

如果你身處一艘正在慢慢沉沒的巨輪之上

你說你能做什麼?投資什麼?

首先自己要穿好救生衣

就像每次坐飛

- 讚賞

- 1

- 留言

- 轉發

- 分享

【$BARD 信號】做多 - 1H突破回踩確認,負費率轧空進行時

$BARD 1H級別在經歷短暫回調後,於1.027附近重新站穩EMA20(0.9940)上方,形成突破回踩結構。4H級別EMA20(0.9141)與EMA50(0.8510)呈強勁多頭排列,趨勢明確。當前價格已突破前高1.0216,動量回歸。

🎯方向:做多 (Long)

⚡入場/掛單:1.026 - 1.030

🛑止損:0.995

🚀目標1:1.080

🚀目標2:1.120

🛡️交易管理:

- 執行策略:價格到達目標1後,減倉50%鎖定利潤,並將剩餘倉位的止損上移至入場價1.026。若價格強勢突破1.080並站穩,可將剩餘倉位止損上移至1.065,博取第二目標。

(深度邏輯:核心驅動在於負資金費率(-0.0871%)與價格強勢的背離,典型的轧空結構。持倉量(OI)保持穩定,未因價格上漲而下降,說明並非單純空頭平倉,可能有新多資金入場。1H RSI(64.41)處於健康區域,有進一步上行空間。盘口深度顯示賣單在1.0271上方較為稀疏,突破後上行阻力小。下方1.000-1.010區域在1H K線中形成密集成交區,構成強支撐。)

查看實時行情 👇 $BARD

---

關注我:獲取更多加密市場實時分析與洞察! $BTC $ETH $SOL

#我在Gate广场过新年 #美国以色列突袭伊朗BTC短线跳水

查看原文$BARD 1H級別在經歷短暫回調後,於1.027附近重新站穩EMA20(0.9940)上方,形成突破回踩結構。4H級別EMA20(0.9141)與EMA50(0.8510)呈強勁多頭排列,趨勢明確。當前價格已突破前高1.0216,動量回歸。

🎯方向:做多 (Long)

⚡入場/掛單:1.026 - 1.030

🛑止損:0.995

🚀目標1:1.080

🚀目標2:1.120

🛡️交易管理:

- 執行策略:價格到達目標1後,減倉50%鎖定利潤,並將剩餘倉位的止損上移至入場價1.026。若價格強勢突破1.080並站穩,可將剩餘倉位止損上移至1.065,博取第二目標。

(深度邏輯:核心驅動在於負資金費率(-0.0871%)與價格強勢的背離,典型的轧空結構。持倉量(OI)保持穩定,未因價格上漲而下降,說明並非單純空頭平倉,可能有新多資金入場。1H RSI(64.41)處於健康區域,有進一步上行空間。盘口深度顯示賣單在1.0271上方較為稀疏,突破後上行阻力小。下方1.000-1.010區域在1H K線中形成密集成交區,構成強支撐。)

查看實時行情 👇 $BARD

---

關注我:獲取更多加密市場實時分析與洞察! $BTC $ETH $SOL

#我在Gate广场过新年 #美国以色列突袭伊朗BTC短线跳水

- 讚賞

- 1

- 留言

- 轉發

- 分享

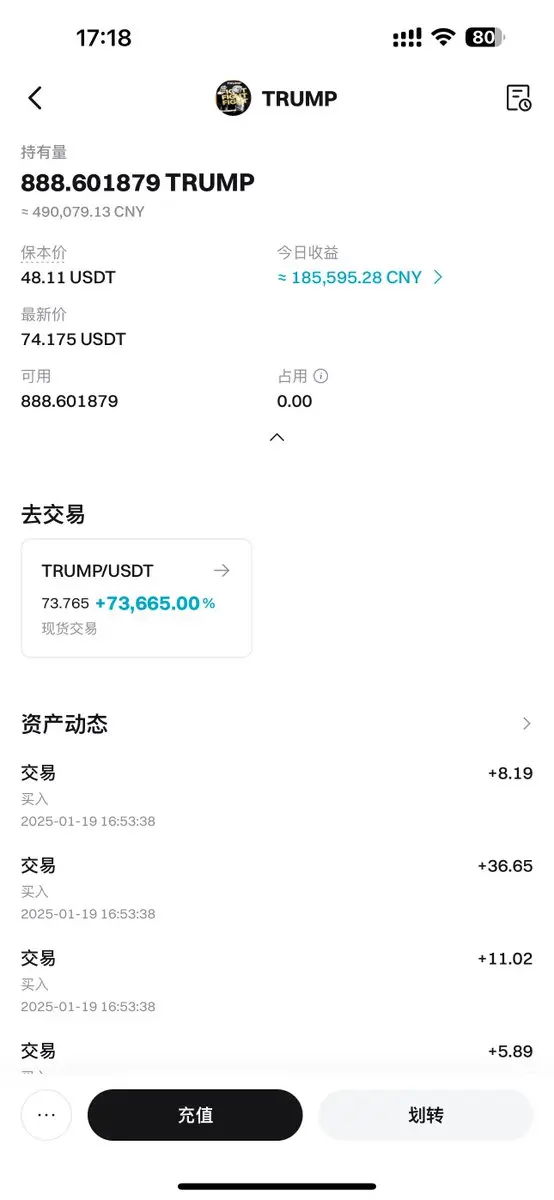

傻子都能賺錢的幣到底什麼時候再來

查看原文

- 讚賞

- 點讚

- 留言

- 轉發

- 分享

- 讚賞

- 2

- 留言

- 轉發

- 分享

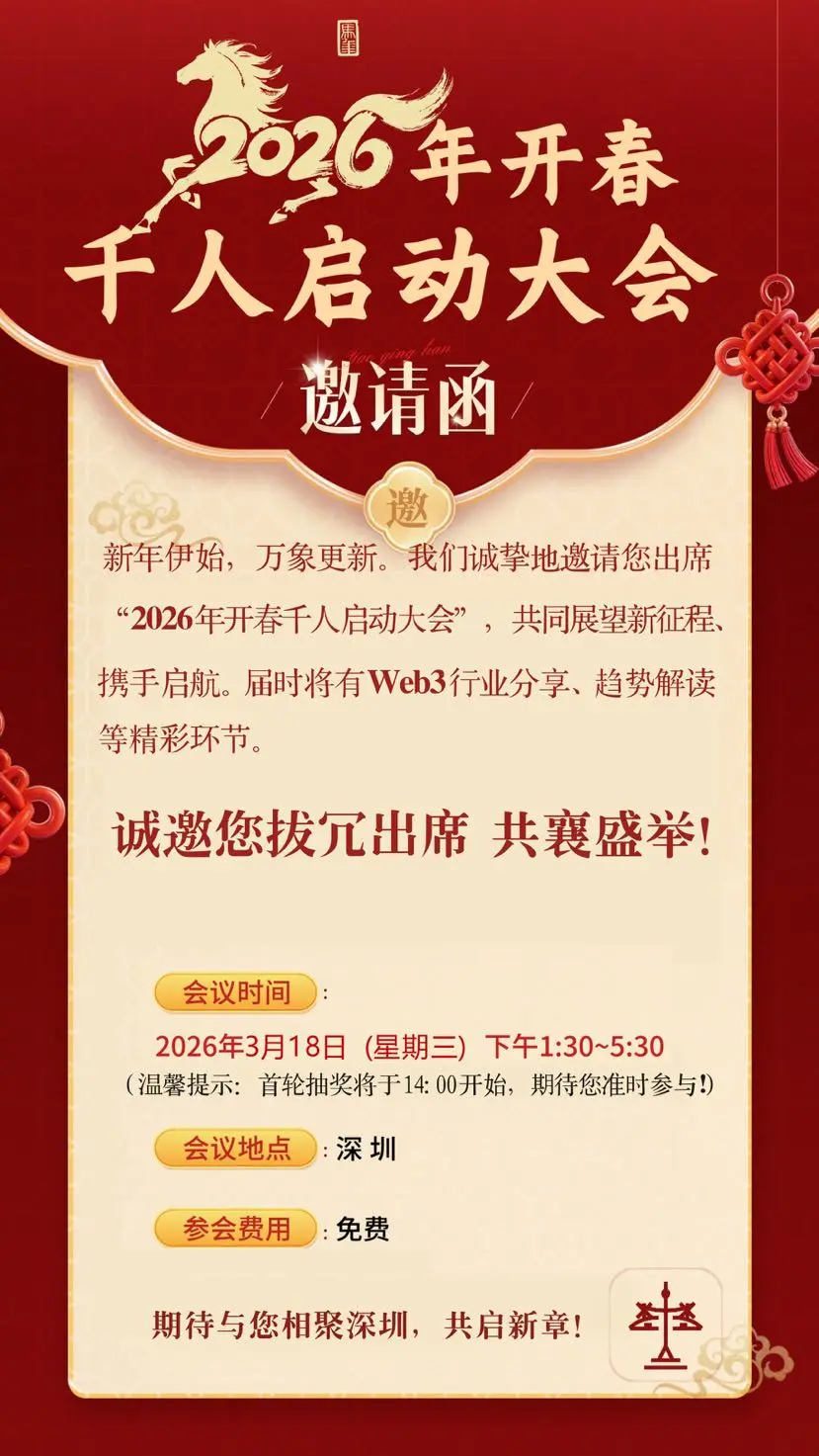

奧丁天平⚖️社區共建共識共贏🤝🏻

3月全球🌐千人會

4月全球🌐週年慶

5月全球🌐共識會

6月全球🌐遊學會

7月,8月,9月,10月,11月,12月

奧丁天平⚖️每個月都有計劃有方向有目標去推進,

2026年天平⚖️就是一隻大金狗,年底目標150刀見!🔥🔥🔥

$CRYPTOBURG

3月全球🌐千人會

4月全球🌐週年慶

5月全球🌐共識會

6月全球🌐遊學會

7月,8月,9月,10月,11月,12月

奧丁天平⚖️每個月都有計劃有方向有目標去推進,

2026年天平⚖️就是一隻大金狗,年底目標150刀見!🔥🔥🔥

$CRYPTOBURG

CRYPTOBURG-9.18%

- 讚賞

- 2

- 1

- 轉發

- 分享

奥丁天平1000倍 :

:

吉祥如意 🧧- 讚賞

- 1

- 留言

- 轉發

- 分享

加載更多

加入 4000萬 人匯聚的頭部社群

⚡️ 與 4000萬 人一起參與加密貨幣熱潮討論

💬 與喜愛的頭部創作者互動

👍 查看感興趣的內容

熱門話題

查看更多4247.16萬 熱度

15.79萬 熱度

11.94萬 熱度

167.39萬 熱度

51.88萬 熱度

最新消息

查看更多置頂

Gate 廣場|2/27 今日話題: #BTC能否重返7万美元?

🎁 帶話題發帖,抽 5 位幸運兒送出 $2,500 仓位體驗券!

Jane Street 被起訴後,持續多日的“10 點砸盤”疑似消失。BTC 目前在 $67,000 附近震盪,這波反彈能否順勢衝回 $70,000?

💬 本期熱議:

1️⃣ 你認為訴訟與“10 點拋壓”消失有關嗎?市場操縱阻力是否減弱?

2️⃣ 衝擊 $70K 的關鍵壓力區在哪?

3️⃣ 你會在當前價位分批布局,還是等待放量突破再進場?

分享觀點,瓜分好禮 👉️ https://www.gate.com/post

📅 2/27 16:00 - 3/1 12:00 (UTC+8)Gate廣場每日優選好文重磅開啟!

📅 活動時間:2月26日 - 3月2日(連續5天)

💰 總獎池:750 USDT

📌 活動規則

發布原創深度文章(建議≥200字)

添加話題 #深度创作营

每日評選3篇優選好文

每人獲獎 50 USDT + 官方流量曝光(轉推、App推送、置頂等)

✨ 深度內容,值得被看見!每日公布獲獎名單,敬請關注!

📄 活動詳情:www.gate.com/announcements/article/49933

👉 立即進入Gate廣場:gate.com/post